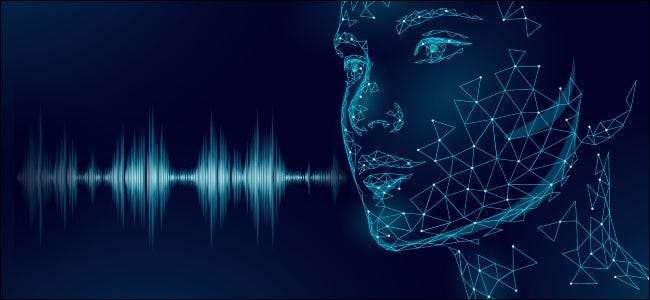

Οι deepfakes βίντεο σημαίνουν ότι δεν μπορείτε να εμπιστευτείτε όλα όσα βλέπετε. Τώρα, τα deepfakes ήχου μπορεί να σημαίνει ότι δεν μπορείτε πλέον να εμπιστεύεστε τα αυτιά σας. Ήταν πραγματικά ο πρόεδρος που κηρύσσει πόλεμο στον Καναδά; Είναι πραγματικά ο μπαμπάς σου στο τηλέφωνο ζητώντας τον κωδικό πρόσβασης του email του;

Προσθέστε μια άλλη υπαρξιακή ανησυχία στη λίστα για το πώς οι δικοί μας ύβροι θα μπορούσαν αναπόφευκτα να μας καταστρέψουν. Κατά την εποχή του Ρέιγκαν, οι μόνοι πραγματικοί τεχνολογικοί κίνδυνοι ήταν η απειλή του πυρηνικού, χημικού και βιολογικού πολέμου.

Τα επόμενα χρόνια, είχαμε την ευκαιρία να εμμείνουμε στο γκρι goo της nanotech και στις παγκόσμιες πανδημίες. Τώρα, έχουμε deepfakes - οι άνθρωποι χάνουν τον έλεγχο της ομοιότητας ή της φωνής τους.

Τι είναι ένα Deepfake ήχου;

Οι περισσότεροι από εμάς είδαμε ένα βίντεο deepfake , στους οποίους οι αλγόριθμοι βαθιάς μάθησης χρησιμοποιούνται για να αντικαταστήσουν ένα άτομο με την ομοιότητα κάποιου άλλου. Τα καλύτερα είναι εξαιρετικά ανησυχητικά ρεαλιστικά και τώρα είναι η σειρά του ήχου. Ένα deepfake ήχου είναι όταν χρησιμοποιείται μια "κλωνοποιημένη" φωνή που δυνητικά δεν μπορεί να διακριθεί από το πραγματικό άτομο για την παραγωγή συνθετικού ήχου.

«Είναι σαν το Photoshop για φωνή», δήλωσε ο Zohaib Ahmed, Διευθύνων Σύμβουλος της Μοιάζουν με AI , για την τεχνολογία κλωνοποίησης φωνής της εταιρείας του.

Ωστόσο, οι κακές εργασίες του Photoshop αποσυνδέονται εύκολα. Μια εταιρεία ασφαλείας με την οποία μιλήσαμε με τους εν λόγω ανθρώπους συνήθως μαντέψουν μόνο εάν ένα deepfake ήχου είναι πραγματικό ή ψεύτικο με ακρίβεια περίπου 57 τοις εκατό - όχι καλύτερο από ένα κέρμα.

Επιπλέον, επειδή τόσες πολλές εγγραφές φωνής είναι τηλεφωνικών κλήσεων χαμηλής ποιότητας (ή καταγράφονται σε θορυβώδεις τοποθεσίες), τα deepfakes ήχου μπορούν να γίνουν ακόμη πιο διακριτά. Όσο χειρότερη είναι η ποιότητα του ήχου, τόσο πιο δύσκολο είναι να πάρει αυτά τα ενδεικτικά σημάδια ότι μια φωνή δεν είναι πραγματική.

Αλλά γιατί θα χρειαζόταν κανείς ένα Photoshop για φωνές;

Η συναρπαστική θήκη για συνθετικό ήχο

Υπάρχει πραγματικά μια τεράστια ζήτηση για συνθετικό ήχο. Σύμφωνα με τον Ahmed, «η απόδοση επένδυσης είναι πολύ άμεση».

Αυτό ισχύει ιδιαίτερα όταν πρόκειται για τυχερά παιχνίδια. Στο παρελθόν, η ομιλία ήταν το μόνο συστατικό ενός παιχνιδιού που ήταν αδύνατο να δημιουργηθεί κατ 'απαίτηση. Ακόμα και σε διαδραστικούς τίτλους με σκηνές ποιότητας κινηματογράφου που αποδίδονται σε πραγματικό χρόνο, οι λεκτικές αλληλεπιδράσεις με χαρακτήρες που δεν παίζουν είναι πάντα ουσιαστικά στατικές.

Τώρα, όμως, η τεχνολογία έχει φτάσει. Τα στούντιο έχουν τη δυνατότητα να κλωνοποιήσουν τη φωνή ενός ηθοποιού και να χρησιμοποιούν μηχανές κειμένου σε ομιλία, ώστε οι χαρακτήρες να μπορούν να λένε οτιδήποτε σε πραγματικό χρόνο.

Υπάρχουν επίσης πιο παραδοσιακές χρήσεις στη διαφήμιση, καθώς και υποστήριξη τεχνολογίας και πελατών. Εδώ, μια φωνή που ακούγεται αυθεντικά ανθρώπινη και αποκρίνεται προσωπικά και συμφραζόμενα χωρίς ανθρώπινη συμβολή είναι αυτό που είναι σημαντικό.

Οι εταιρείες κλωνοποίησης φωνής είναι επίσης ενθουσιασμένες για τις ιατρικές εφαρμογές. Φυσικά, η αντικατάσταση φωνής δεν είναι κάτι καινούργιο στην ιατρική - ο Stephen Hawking χρησιμοποίησε διάσημα μια ρομποτική συνθετική φωνή αφού έχασε τη δική του το 1985. Ωστόσο, η σύγχρονη κλωνοποίηση φωνής υπόσχεται κάτι ακόμα καλύτερο.

Το 2008, συνθετική εταιρεία φωνής, CereProc , έδωσε στον ύστερο κριτικό του κινηματογράφου, Ρότζερ Έμπερτ, τη φωνή του πίσω, αφού ο καρκίνος το πήρε. Η CereProc είχε δημοσιεύσει μια ιστοσελίδα που επέτρεπε στους ανθρώπους να πληκτρολογούν μηνύματα τα οποία στη συνέχεια θα εκφωνούσαν με τη φωνή του πρώην προέδρου Τζορτζ Μπους.

«Ο Ebert το είδε και σκέφτηκε,« καλά, αν μπορούσαν να αντιγράψουν τη φωνή του Μπους, θα έπρεπε να μπορούν να αντιγράψουν τη δική μου », δήλωσε ο Matthew Aylett, διευθύνων σύμβουλος του CereProc. Στη συνέχεια, ο Ebert ζήτησε από την εταιρεία να δημιουργήσει μια φωνή αντικατάστασης, την οποία έκαναν επεξεργάζοντας μια μεγάλη βιβλιοθήκη ηχογραφήσεων.

«Ήταν μια από τις πρώτες φορές που κάποιος το είχε κάνει αυτό και ήταν μια πραγματική επιτυχία», δήλωσε ο Aylett.

Τα τελευταία χρόνια, αρκετές εταιρείες (συμπεριλαμβανομένης της CereProc) συνεργάστηκαν με το Ένωση ALS επί Τιμολόγηση έργου να παρέχει συνθετικές φωνές σε όσους πάσχουν από ALS.

Πώς λειτουργεί το Synthetic Audio

Η φωνητική κλωνοποίηση έχει μια στιγμή αυτή τη στιγμή, και πολλές εταιρείες αναπτύσσουν εργαλεία. Μοιάζουν με AI και Περιγραφή έχετε online επιδείξεις οποιονδήποτε μπορεί να δοκιμάσει δωρεάν. Καταγράφετε μόνο τις φράσεις που εμφανίζονται στην οθόνη και, σε λίγα λεπτά, δημιουργείται ένα μοντέλο της φωνής σας.

Μπορείτε να ευχαριστήσετε την AI - συγκεκριμένα, αλγόριθμοι βαθιάς μάθησης —Για να μπορέσετε να αντιστοιχίσετε την ηχογραφημένη ομιλία με το κείμενο για να κατανοήσετε τα φωνητικά στοιχεία που συνθέτουν τη φωνή σας. Στη συνέχεια, χρησιμοποιεί τα προκύπτοντα γλωσσικά δομικά στοιχεία για να προσεγγίσει τις λέξεις που δεν έχει ακούσει να μιλάτε.

Η βασική τεχνολογία υπάρχει εδώ και αρκετό καιρό, αλλά όπως επεσήμανε ο Aylett, χρειάστηκε κάποια βοήθεια.

«Η αντιγραφή φωνής ήταν σαν να φτιάχνω ζαχαροπλαστική», είπε. «Ήταν δύσκολο να κάνεις και υπήρχαν διάφοροι τρόποι με τους οποίους έπρεπε να το τροποποιήσεις με το χέρι για να το κάνεις στη δουλειά».

Οι προγραμματιστές χρειάζονταν τεράστιες ποσότητες εγγεγραμμένων φωνητικών δεδομένων για να πάρουν αποδεκτά αποτελέσματα. Στη συνέχεια, πριν από λίγα χρόνια, οι πύλες πλημμύρας άνοιξαν. Η έρευνα στον τομέα της όρασης του υπολογιστή αποδείχθηκε κρίσιμη. Οι επιστήμονες ανέπτυξαν γενετικά αντιπολικά δίκτυα (GANs), τα οποία θα μπορούσαν, για πρώτη φορά, να κάνουν παρέκταση και να κάνουν προβλέψεις με βάση τα υπάρχοντα δεδομένα.

«Αντί για έναν υπολογιστή να βλέπει μια εικόνα ενός αλόγου και να λέει« αυτό είναι ένα άλογο », το μοντέλο μου θα μπορούσε τώρα να κάνει ένα άλογο σε ζέβρα», δήλωσε ο Aylett. «Έτσι, η έκρηξη στη σύνθεση ομιλίας τώρα είναι χάρη στο ακαδημαϊκό έργο από το όραμα του υπολογιστή»

Μία από τις μεγαλύτερες καινοτομίες στην κλωνοποίηση φωνής ήταν η συνολική μείωση του ποσού των ανεπεξέργαστων δεδομένων για τη δημιουργία μιας φωνής. Στο παρελθόν, τα συστήματα χρειάζονταν δεκάδες ή και εκατοντάδες ώρες ήχου. Τώρα, ωστόσο, ικανές φωνές μπορούν να δημιουργηθούν από λίγα λεπτά περιεχομένου.

ΣΧΕΤΙΖΟΜΑΙ ΜΕ: Το πρόβλημα με την τεχνητή νοημοσύνη: Οι μηχανές μαθαίνουν πράγματα, αλλά δεν μπορούν να τα καταλάβουν

Ο υπαρξιακός φόβος για μη εμπιστοσύνη σε τίποτα

Αυτή η τεχνολογία, μαζί με την πυρηνική ενέργεια, τη νανοτεχνολογία, την εκτύπωση 3D και το CRISPR, είναι ταυτόχρονα συναρπαστική και τρομακτική. Σε τελική ανάλυση, υπήρξαν ήδη περιπτώσεις στις ειδήσεις των ανθρώπων που εξαπατήθηκαν από κλώνους φωνής. Το 2019, μια εταιρεία στο Ηνωμένο Βασίλειο ισχυρίστηκε ότι ήταν εξαπατήθηκε από ένα deepfake ήχου τηλεφωνική κλήση σε χρηματικά ποσά σε εγκληματίες.

Δεν χρειάζεται να πάτε μακριά για να βρείτε εκπληκτικά πειστικά ψεύτικα ήχου. Κανάλι YouTube Φωνητική σύνθεση περιλαμβάνει γνωστούς ανθρώπους που λένε πράγματα που δεν είπαν ποτέ Ο Τζορτζ Μπους διαβάζει το "In Da Club" κατά 50 Cent . Είναι ακριβές.

Αλλού στο YouTube, μπορείτε να ακούσετε ένα σμήνος πρώην Προέδρων, όπως Ο Ομπάμα, η Κλίντον και ο Ρέιγκαν, χτυπούν το NWA . Οι ήχοι της μουσικής και του φόντου βοηθούν να συγκαλύψουν μερικές από τις προφανείς ρομποτικές δυσλειτουργίες, αλλά ακόμη και σε αυτήν την ατελή κατάσταση, το δυναμικό είναι προφανές.

Πειραματιστήκαμε με τα εργαλεία Μοιάζουν με AI και Περιγραφή και δημιούργησε φωνητικό κλώνο. Το Descript χρησιμοποιεί μια μηχανή κλωνοποίησης φωνής που αρχικά ονομαζόταν Lyrebird και ήταν ιδιαίτερα εντυπωσιακή. Ήμασταν σοκαρισμένοι με την ποιότητα. Το να ακούτε τη δική σας φωνή να λέει πράγματα που γνωρίζετε ότι δεν έχετε πει ποτέ είναι άσχημο.

Υπάρχει σίγουρα μια ρομποτική ποιότητα στην ομιλία, αλλά σε μια περιστασιακή ακρόαση, οι περισσότεροι άνθρωποι δεν θα είχαν κανένα λόγο να πιστεύουν ότι ήταν ψεύτικο.

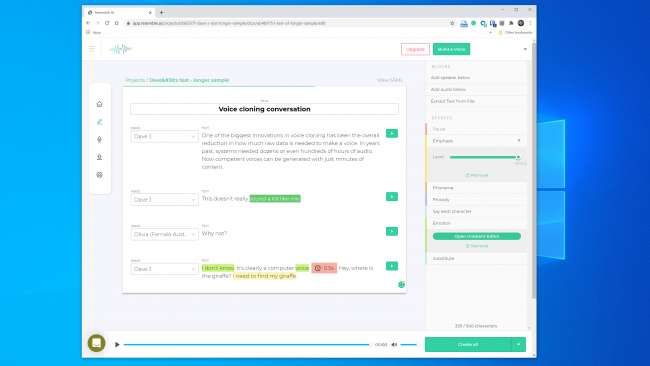

Είχαμε ακόμη μεγαλύτερες ελπίδες για το Resemble AI. Σας δίνει τα εργαλεία για να δημιουργήσετε μια συνομιλία με πολλές φωνές και να διαφοροποιήσετε την εκφραστικότητα, το συναίσθημα και το ρυθμό του διαλόγου. Ωστόσο, δεν πιστεύαμε ότι το φωνητικό μοντέλο αποτύπωσε τις βασικές ιδιότητες της φωνής που χρησιμοποιήσαμε. Στην πραγματικότητα, ήταν απίθανο να ξεγελάσει κανέναν.

Ένας εκπρόσωπος της Resemble AI μας είπε «οι περισσότεροι άνθρωποι εκνευρίζονται από τα αποτελέσματα εάν το κάνουν σωστά». Κατασκευάσαμε ένα φωνητικό μοντέλο δύο φορές με παρόμοια αποτελέσματα. Επομένως, προφανώς, δεν είναι πάντα εύκολο να φτιάξετε έναν κλώνο φωνής που μπορείτε να χρησιμοποιήσετε για να τραβήξετε μια ψηφιακή κλοπή.

Ακόμα κι έτσι, ο ιδρυτής του Lyrebird (που είναι τώρα μέρος του Descript), Kundan Kumar, πιστεύει ότι έχουμε ήδη περάσει αυτό το όριο.

«Για ένα μικρό ποσοστό περιπτώσεων, είναι ήδη εκεί», είπε ο Kumar. "Αν χρησιμοποιώ συνθετικό ήχο για να αλλάξω μερικές λέξεις σε μια ομιλία, είναι ήδη τόσο καλό που θα δυσκολευτείτε να μάθετε τι άλλαξε."

Μπορούμε επίσης να υποθέσουμε ότι αυτή η τεχνολογία θα βελτιωθεί μόνο με το χρόνο. Τα συστήματα θα χρειάζονται λιγότερο ήχο για να δημιουργήσουν ένα μοντέλο και οι γρηγορότεροι επεξεργαστές θα μπορούν να κατασκευάσουν το μοντέλο σε πραγματικό χρόνο. Η πιο έξυπνη τεχνητή νοημοσύνη θα μάθει πώς να προσθέτει πιο πειστικό ρυθμό που μοιάζει με τον άνθρωπο και έμφαση στην ομιλία χωρίς να έχει ένα παράδειγμα εργασίας.

Αυτό σημαίνει ότι ίσως ερχόμαστε πιο κοντά στην ευρεία διαθεσιμότητα της εύκολης κλωνοποίησης φωνής.

Η ηθική του κουτιού της Πανδώρας

Οι περισσότερες εταιρείες που εργάζονται σε αυτόν τον χώρο φαίνεται έτοιμοι να χειριστούν την τεχνολογία με ασφαλή και υπεύθυνο τρόπο. Για παράδειγμα, μοιάζει με AI μια ολόκληρη ενότητα «Ηθική» στον ιστότοπό της , και το ακόλουθο απόσπασμα είναι ενθαρρυντικό:

«Συνεργαζόμαστε με εταιρείες μέσω μιας αυστηρής διαδικασίας για να βεβαιωθούμε ότι η φωνή που κλωνοποιούν μπορεί να χρησιμοποιηθεί από αυτές και ότι έχουμε τη σωστή συγκατάθεση με τους ηθοποιούς φωνής»

Ομοίως, ο Kumar είπε ότι ο Lyrebird ανησυχεί για την κατάχρηση από την αρχή. Γι 'αυτό τώρα, ως μέρος της περιγραφής, επιτρέπει μόνο στους ανθρώπους να κλωνοποιούν τη δική τους φωνή. Στην πραγματικότητα, τόσο το Resemble όσο και το Descript απαιτούν από τους ανθρώπους να εγγράψουν τα δείγματά τους ζωντανά για να αποτρέψουν τη μη συναινετική κλωνοποίηση φωνής.

Είναι ενθαρρυντικό το γεγονός ότι οι μεγάλοι εμπορικοί παίκτες έχουν επιβάλει ορισμένες ηθικές οδηγίες Ωστόσο, είναι σημαντικό να θυμάστε ότι αυτές οι εταιρείες δεν είναι φύλακες αυτής της τεχνολογίας. Υπάρχουν πολλά εργαλεία ανοιχτού κώδικα ήδη στο φυσικό περιβάλλον, για τα οποία δεν υπάρχουν κανόνες. Σύμφωνα με τον Henry Ajder, επικεφαλής των πληροφοριών απειλής στο Βαθύ ίχνος , επίσης, δεν χρειάζεστε προηγμένες γνώσεις κωδικοποίησης για να την κακή χρήση.

«Πολλή πρόοδος στον χώρο έχει προέλθει από συνεργατική εργασία σε μέρη όπως το GitHub, χρησιμοποιώντας εφαρμογές ανοιχτού κώδικα προηγούμενων δημοσιευμένων ακαδημαϊκών εργασιών», δήλωσε ο Ajder. "Μπορεί να χρησιμοποιηθεί από οποιονδήποτε έχει μέτρια επάρκεια στην κωδικοποίηση."

Οι επαγγελματίες ασφαλείας το έχουν δει όλα αυτά πριν

Οι εγκληματίες έχουν προσπαθήσει να κλέψουν χρήματα μέσω τηλεφώνου πολύ πριν καταστεί δυνατή η φωνητική κλωνοποίηση και οι ειδικοί ασφαλείας ήταν πάντα σε ετοιμότητα για να το εντοπίσουν και να το αποτρέψουν. Εταιρεία ασφαλείας Πίνδρο προσπαθεί να σταματήσει την τραπεζική απάτη, επαληθεύοντας εάν ένας καλούντος είναι αυτός που ισχυρίζεται ότι προέρχεται από τον ήχο. Μόνο το 2019, η Pindrop ισχυρίζεται ότι ανέλυσε 1,2 δισεκατομμύρια φωνητικές αλληλεπιδράσεις και απέτρεψε περίπου 470 εκατομμύρια δολάρια σε απόπειρες απάτης.

Πριν από την κλωνοποίηση φωνής, οι απατεώνες δοκίμασαν πολλές άλλες τεχνικές. Το απλούστερο ήταν απλώς κλήση από αλλού με προσωπικές πληροφορίες σχετικά με το σήμα.

«Η ακουστική μας υπογραφή μας επιτρέπει να διαπιστώσουμε ότι μια κλήση προέρχεται πραγματικά από ένα τηλέφωνο Skype στη Νιγηρία λόγω των χαρακτηριστικών του ήχου», δήλωσε ο διευθύνων σύμβουλος της Pindrop, Vijay Balasubramaniyan. «Στη συνέχεια, μπορούμε να συγκρίνουμε ότι γνωρίζοντας ότι ο πελάτης χρησιμοποιεί ένα τηλέφωνο AT&T στην Ατλάντα.»

Μερικοί εγκληματίες έχουν επίσης κάνει καριέρα από τη χρήση ήχων στο παρασκήνιο για να πετάξουν τους τραπεζικούς αντιπροσώπους.

«Υπάρχει ένας απατεώνας που ονομάζαμε Chicken Man που πάντα είχε κοκόρια στο παρασκήνιο», δήλωσε ο Balasubramaniyan. «Και υπάρχει μια κυρία που χρησιμοποίησε ένα μωρό που κλαίει στο παρασκήνιο για να πείσει ουσιαστικά τους πράκτορες του τηλεφωνικού κέντρου, ότι« γεια, περνάω μια δύσκολη στιγμή »για να πάρω συμπάθεια».

Και τότε υπάρχουν οι άνδρες εγκληματίες που ακολουθούν τους τραπεζικούς λογαριασμούς των γυναικών.

«Χρησιμοποιούν τεχνολογία για να αυξήσουν τη συχνότητα της φωνής τους, για να ακούγονται πιο θηλυκά», εξήγησε ο Balasubramaniyan. Αυτά μπορεί να είναι επιτυχημένα, αλλά «περιστασιακά, το λογισμικό βλάπτει και ακούγονται σαν τον Alvin και τους Chipmunks.»

Φυσικά, η φωνητική κλωνοποίηση είναι μόνο η τελευταία εξέλιξη σε αυτόν τον συνεχώς αυξανόμενο πόλεμο. Οι εταιρείες ασφαλείας έχουν ήδη πιάσει απατεώνες που χρησιμοποιούν συνθετικό ήχο σε τουλάχιστον μία επίθεση ψαροντούφεκου.

"Με τον σωστό στόχο, η πληρωμή μπορεί να είναι τεράστια", δήλωσε ο Balasubramaniyan. "Έτσι, είναι λογικό να αφιερώσουμε το χρόνο για να δημιουργήσουμε μια συνθετική φωνή του σωστού ατόμου."

Μπορεί κανείς να πει εάν μια φωνή είναι ψεύτικη;

Όσον αφορά την αναγνώριση εάν μια φωνή έχει παραποιηθεί, υπάρχουν τόσο καλά όσο και κακά νέα. Το κακό είναι ότι οι κλώνοι φωνής γίνονται καλύτεροι κάθε μέρα. Τα συστήματα βαθιάς μάθησης γίνονται εξυπνότερα και κάνουν πιο αυθεντικές φωνές που απαιτούν λιγότερο ήχο για τη δημιουργία.

Όπως μπορείτε να πείτε από αυτό το κλιπ του Ο Πρόεδρος Ομπάμα λέει στον MC Ren να λάβει θέση Έχουμε ήδη φτάσει στο σημείο όπου ένα υψηλής πιστότητας, προσεκτικά κατασκευασμένο φωνητικό μοντέλο μπορεί να ακούγεται αρκετά πειστικό για το ανθρώπινο αυτί.

Όσο περισσότερο είναι ένα κλιπ ήχου, τόσο πιο πιθανό είναι να παρατηρήσετε ότι κάτι δεν πάει καλά. Ωστόσο, για μικρότερα κλιπ, ίσως να μην παρατηρήσετε ότι είναι συνθετικό - ειδικά αν δεν έχετε λόγο να αμφισβητήσετε τη νομιμότητά του.

Όσο πιο καθαρή είναι η ποιότητα του ήχου, τόσο πιο εύκολο είναι να παρατηρήσετε σημάδια ενός deepfake ήχου. Εάν κάποιος μιλάει απευθείας σε μικρόφωνο ποιότητας στούντιο, θα μπορείτε να το ακούσετε προσεκτικά. Ωστόσο, μια κακή εγγραφή τηλεφωνικών κλήσεων ή μια συνομιλία που καταγράφεται σε μια φορητή συσκευή σε ένα θορυβώδες γκαράζ στάθμευσης θα είναι πολύ πιο δύσκολο να εκτιμηθεί.

Τα καλά νέα είναι ότι, ακόμη και αν οι άνθρωποι έχουν πρόβλημα να διαχωρίσουν το πραγματικό από το ψεύτικο, οι υπολογιστές δεν έχουν τους ίδιους περιορισμούς. Ευτυχώς, υπάρχουν ήδη εργαλεία φωνητικής επαλήθευσης. Το Pindrop έχει ένα που βάζει συστήματα βαθιάς μάθησης το ένα εναντίον του άλλου. Χρησιμοποιεί και τα δύο για να ανακαλύψει εάν ένα ηχητικό δείγμα είναι το άτομο που πρέπει να είναι. Ωστόσο, εξετάζει επίσης εάν ένας άνθρωπος μπορεί ακόμη και να κάνει όλους τους ήχους του δείγματος.

Ανάλογα με την ποιότητα του ήχου, κάθε δευτερόλεπτο ομιλίας περιέχει 8.000-50.000 δείγματα δεδομένων που μπορούν να αναλυθούν.

"Τα πράγματα που συνήθως αναζητούμε είναι περιορισμοί στην ομιλία λόγω της ανθρώπινης εξέλιξης", εξήγησε ο Balasubramaniyan.

Για παράδειγμα, δύο φωνητικοί ήχοι έχουν τον ελάχιστο δυνατό διαχωρισμό μεταξύ τους. Αυτό συμβαίνει επειδή δεν είναι φυσιολογικά δυνατό να τους πούμε γρηγορότερα λόγω της ταχύτητας με την οποία οι μύες στο στόμα και τα φωνητικά κορδόνια μπορούν να αναδιαμορφωθούν.

«Όταν εξετάζουμε τον συνθετικό ήχο», είπε ο Balasubramaniyan, «βλέπουμε μερικές φορές πράγματα και λέμε,« αυτό δεν θα μπορούσε ποτέ να έχει δημιουργηθεί από έναν άνθρωπο, επειδή το μόνο άτομο που θα μπορούσε να έχει δημιουργήσει αυτό πρέπει να έχει λαιμό μήκους επτά ποδιών. "

Υπάρχει επίσης μια κατηγορία ήχου που ονομάζεται "fricatives". Σχηματίζονται όταν ο αέρας περνά από μια στενή συστολή στον λαιμό σας όταν προφέρετε γράμματα όπως f, s, v και z. Τα fricatives είναι ιδιαίτερα δύσκολα για να μάθουν τα συστήματα βαθιάς μάθησης, επειδή το λογισμικό δυσκολεύεται να τα διαφοροποιήσει από το θόρυβο.

Έτσι, τουλάχιστον για τώρα, το λογισμικό κλωνοποίησης φωνής σκοντάφτει από το γεγονός ότι οι άνθρωποι είναι σάκοι κρέατος που ρέουν αέρα μέσα από τρύπες στο σώμα τους για να μιλήσουν.

«Συνεχίζω να αστειεύομαι ότι τα deepfakes είναι πολύ χυδαία», είπε ο Balasubramaniyan. Εξήγησε ότι είναι πολύ δύσκολο για τους αλγορίθμους να διακρίνουν τα άκρα των λέξεων από το θόρυβο του φόντου σε μια ηχογράφηση. Αυτό έχει ως αποτέλεσμα πολλά φωνητικά μοντέλα με ομιλία που ξεπερνούν περισσότερο από ό, τι οι άνθρωποι.

«Όταν ένας αλγόριθμος βλέπει αυτό να συμβαίνει πολύ», είπε ο Balasubramaniyan, «στατιστικά, γίνεται πιο σίγουρο ότι είναι ήχος που έχει δημιουργηθεί σε αντίθεση με τον άνθρωπο».

Το Resemble AI αντιμετωπίζει επίσης το πρόβλημα ανίχνευσης με το Resemblyzer, ένα εργαλείο βαθιάς μάθησης ανοιχτού κώδικα διαθέσιμο στο GitHub . Μπορεί να εντοπίσει ψεύτικες φωνές και να πραγματοποιήσει επαλήθευση ηχείου.

Χρειάζεται επαγρύπνηση

Είναι πάντα δύσκολο να μαντέψουμε τι μπορεί να έχει το μέλλον, αλλά αυτή η τεχνολογία σχεδόν σίγουρα θα βελτιωθεί. Επίσης, οποιοσδήποτε θα μπορούσε ενδεχομένως να είναι θύμα - όχι μόνο άτομα υψηλού προφίλ, όπως εκλεγμένοι αξιωματούχοι ή CEOs τραπεζών.

"Νομίζω ότι βρισκόμαστε στο χείλος της πρώτης παραβίασης ήχου όπου κλέβονται οι φωνές των ανθρώπων", προέβλεψε ο Balasubramaniyan.

Προς το παρόν, όμως, ο πραγματικός κίνδυνος από deepfakes ήχου είναι χαμηλός. Υπάρχουν ήδη εργαλεία που φαίνεται να κάνουν πολύ καλή δουλειά για την ανίχνευση συνθετικών βίντεο.

Επιπλέον, οι περισσότεροι άνθρωποι δεν διατρέχουν κίνδυνο επίθεσης. Σύμφωνα με τον Ajder, οι κύριοι εμπορικοί παίκτες «εργάζονται για συγκεκριμένες λύσεις για συγκεκριμένους πελάτες, και οι περισσότεροι έχουν αρκετά καλές οδηγίες δεοντολογίας για το ποιον θα ή δεν θα συνεργαζόταν».

Ωστόσο, η πραγματική απειλή βρίσκεται μπροστά, καθώς ο Ajder εξήγησε:

"Το Pandora's Box θα είναι άνθρωποι που συνδυάζουν εφαρμογές ανοιχτού κώδικα της τεχνολογίας σε όλο και πιο φιλικές προς το χρήστη, προσβάσιμες εφαρμογές ή υπηρεσίες που δεν έχουν αυτό το είδος ηθικού επιπέδου ελέγχου που κάνουν οι εμπορικές λύσεις αυτή τη στιγμή."

Αυτό πιθανότατα είναι αναπόφευκτο, αλλά οι εταιρείες ασφαλείας εισάγουν ήδη ψεύτικη ανίχνευση ήχου στις εργαλειοθήκες τους. Ωστόσο, η διατήρηση της ασφάλειας απαιτεί επαγρύπνηση.

"Το έχουμε κάνει σε άλλους τομείς ασφαλείας", δήλωσε ο Ajder. «Πολλοί οργανισμοί ξοδεύουν πολύ χρόνο προσπαθώντας να καταλάβουν ποια είναι η επόμενη ευπάθεια μηδενικών ημερών, για παράδειγμα. Ο συνθετικός ήχος είναι απλά τα επόμενα σύνορα. "

ΣΧΕΤΙΖΟΜΑΙ ΜΕ: Τι είναι το Deepfake και πρέπει να ανησυχώ;