ビデオディープフェイクは、目にするものすべてを信頼できないことを意味します。さて、オーディオディープフェイクはあなたがもはやあなたの耳を信頼できないことを意味するかもしれません。それは本当に大統領がカナダに宣戦布告したのでしょうか?それは本当にあなたのお父さんが彼の電子メールパスワードを求めている電話ですか?

私たち自身の傲慢が必然的に私たちを破壊する可能性がある方法のリストに別の実存的な心配を追加します。レーガン時代の本当の技術的リスクは、核、化学、生物兵器の脅威だけでした。

その後数年間、私たちはナノテクのグレイグーと世界的大流行に執着する機会がありました。今、私たちはディープフェイクを抱えています。人々は自分の肖像や声を制御できなくなります。

オーディオディープフェイクとは何ですか?

私たちのほとんどは見たことがあります ビデオディープフェイク 、ディープラーニングアルゴリズムを使用して、ある人を他の人の肖像に置き換えます。最高のものは神経質に現実的であり、今ではオーディオの番です。オーディオディープフェイクとは、実際の人と見分けがつかない可能性のある「複製された」音声を使用して合成オーディオを生成することです。

「音声用のPhotoshopのようなものです」と、のCEOであるZohaibAhmedは述べています。 AIに似ている 、彼の会社の音声クローン技術について。

ただし、悪いPhotoshopの仕事は簡単に暴かれます。私たちが話をしたセキュリティ会社によると、人々は通常、オーディオのディープフェイクが本物か偽物かを約57%の精度で推測するだけで、コイントスに勝るものはありません。

さらに、非常に多くの音声録音が低品質の通話である(またはノイズの多い場所で録音される)ため、オーディオディープフェイクをさらに見分けがつかないようにすることができます。音質が悪いほど、声が本物ではないという明白な兆候を見つけるのが難しくなります。

しかし、とにかく、なぜ誰かが声のためにPhotoshopを必要とするのでしょうか?

合成オーディオの説得力のある事例

実際、合成オーディオには非常に大きな需要があります。 Ahmedによると、「ROIは非常に即時です。」

これは、ゲームに関しては特に当てはまります。以前は、スピーチはオンデマンドで作成することが不可能だったゲームの1つのコンポーネントでした。映画品質のシーンがリアルタイムでレンダリングされるインタラクティブなタイトルでも、再生されていないキャラクターとの口頭でのやり取りは常に本質的に静的です。

しかし今、テクノロジーは追いついてきました。スタジオには、俳優の声のクローンを作成し、テキスト読み上げエンジンを使用して、キャラクターがリアルタイムで何でも言うことができるようにする可能性があります。

広告、技術および顧客サポートには、より伝統的な用途もあります。ここで重要なのは、本物の人間のように聞こえ、人間の入力なしに個人的および文脈的に反応する声です。

音声クローニング会社も医療アプリケーションに興奮しています。もちろん、音声の置き換えは医学では目新しいことではありません。スティーブンホーキングは、1985年に自分の声を失った後、ロボット合成音声を使用したことで有名です。しかし、現代の音声クローニングはさらに優れたものを約束します。

2008年、合成音声会社、 CereProc 、映画評論家のロジャー・イーバートに、癌がそれを取り除いた後の彼の声を返しました。 CereProcは、人々がメッセージを入力できるWebページを公開しており、メッセージはジョージ・ブッシュ前大統領の声で話されました。

「エバートはそれを見て、「ブッシュの声を真似ることができれば、私の声を真似できるはずだ」と考えました」と、CereProcの最高科学責任者であるマシュー・アイレットは述べています。次に、Ebertは会社に代替の音声を作成するように依頼しました。これは、音声録音の大規模なライブラリを処理することによって行いました。

「それは誰もがこれをした最初の時の1つであり、それは本当の成功でした」とアイレットは言いました。

近年、多くの企業(CereProcを含む)が ALS協会 オン プロジェクトの払い戻し ALSに苦しむ人々に総合的な声を提供するため。

合成オーディオのしくみ

音声クローニングは今、一瞬を迎えており、多くの企業がツールを開発しています。 AIに似ている そして 説明 誰でも無料で試すことができるオンラインデモがあります。画面に表示されるフレーズを録音するだけで、ほんの数分であなたの声のモデルが作成されます。

AIに感謝することができます。具体的には、 深層学習アルゴリズム —録音された音声をテキストに一致させて、音声を構成するコンポーネントの音素を理解できるようにするため。次に、結果として得られる言語構成要素を使用して、あなたが話しているのを聞いたことのない単語を概算します。

基本的な技術はしばらく前からありましたが、アイレットが指摘したように、それはいくつかの助けを必要としました。

「声をコピーすることは、ペストリーを作ることに少し似ていました」と彼は言いました。 「それはちょっと大変で、それを機能させるために手で微調整しなければならないさまざまな方法がありました。」

開発者は、まずまずの結果を得るために、膨大な量の録音された音声データを必要としていました。そして、数年前、水門が開きました。コンピュータビジョンの分野での研究は重要であることが証明されました。科学者は生成的敵対的ネットワーク(GAN)を開発しました。これは、初めて、既存のデータに基づいて外挿し、予測を行うことができました。

「コンピューターが馬の写真を見て「これは馬です」と言う代わりに、私のモデルは馬をシマウマにすることができました」とアイレットは言いました。 「つまり、音声合成の爆発的な増加は、コンピュータービジョンによる学術研究のおかげです。」

音声クローニングの最大の革新の1つは、音声を作成するために必要な生データの量が全体的に削減されたことです。これまで、システムには数十時間、場合によっては数百時間のオーディオが必要でした。しかし今では、ほんの数分のコンテンツから有能な声を生み出すことができます。

関連: AIの問題:機械は物事を学習しているが、それらを理解できない

何も信用しないという実存的な恐怖

このテクノロジーは、原子力、ナノテク、3D印刷、およびCRISPRとともに、同時にスリリングで恐ろしいものです。結局のところ、人々が音声クローンにだまされているというニュースはすでにあります。 2019年に、英国の会社はそれが オーディオディープフェイクにだまされた 犯罪者にお金を配線するための電話。

驚くほど説得力のあるオーディオフェイクを見つけるために遠くまで行く必要もありません。 YouTubeチャンネル 音声合成 よく知られている人々が、 ジョージW.ブッシュが50セントの「インダクラブ」を読んでいる 。それはその場です。

YouTubeの他の場所では、次のような元大統領の群れを聞くことができます。 オバマ、クリントン、レーガン、NWAをラップ 。音楽と背景音は、明らかなロボットの不具合の一部を隠すのに役立ちますが、この不完全な状態でも、可能性は明らかです。

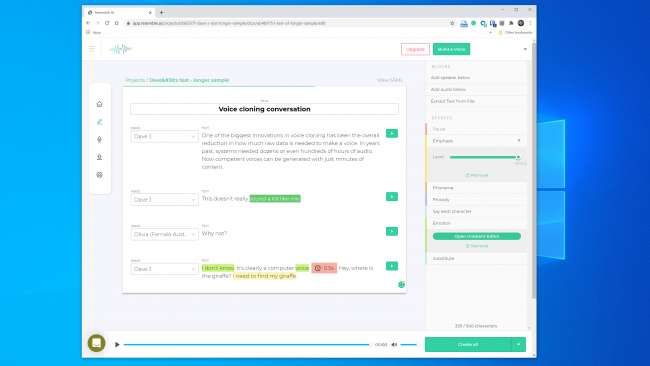

上のツールで実験しました AIに似ている そして 説明 音声クローンを作成しました。 Descriptは、もともとLyrebirdと呼ばれ、特に印象的な音声クローニングエンジンを使用しています。私たちはその品質にショックを受けました。自分の声を聞くと、今まで言ったことのないことがわかっているので不安になります。

スピーチには間違いなくロボットの品質がありますが、カジュアルなリスニングでは、ほとんどの人はそれが偽物であると考える理由がありません。

私たちはResembleAIにさらに高い期待を抱いていました。複数の声で会話を作成し、会話の表現力、感情、ペースを変えるためのツールを提供します。ただし、音声モデルが使用した音声の本質的な品質を捉えているとは思いませんでした。実際、だれかをだますことはありそうにありませんでした。

似たようなAIの担当者は、「正しく実行すれば、ほとんどの人が結果に驚かされる」と語っています。音声モデルを2回作成し、同様の結果を得ました。したがって、明らかに、デジタル強盗を実行するために使用できる音声クローンを作成することは必ずしも簡単ではありません。

それでも、Lyrebird(現在はDescriptの一部です)の創設者であるKundan Kumarは、すでにそのしきい値を超えていると感じています。

「ごく一部のケースでは、すでに存在しています」とクマール氏は述べています。 「私が合成音声を使用してスピーチのいくつかの単語を変更した場合、それはすでに非常に優れているため、何が変更されたかを知るのに苦労するでしょう。」

また、このテクノロジーは時間とともに改善されると想定することもできます。システムはモデルを作成するために必要なオーディオが少なくなり、より高速なプロセッサがリアルタイムでモデルを構築できるようになります。よりスマートなAIは、例を挙げずに、説得力のある人間のようなリズムとスピーチの強調を追加する方法を学習します。

つまり、簡単な音声クローニングが広く利用できるようになる可能性があります。

パンドラの箱の倫理

この分野で働いているほとんどの企業は、安全で責任ある方法でテクノロジーを処理する準備ができているようです。たとえば、AIに似ています ウェブサイトの「倫理」セクション全体 、および次の抜粋は有望です。

「私たちは厳格なプロセスを通じて企業と協力し、企業が複製している音声が使用可能であることを確認し、音声俳優との適切な同意を得ています。」

同様に、Kumarは、Lyrebirdは最初から誤用を懸念していると述べました。そのため、Descriptの一部として、ユーザーは自分の声のクローンを作成することしかできません。実際、ResembleとDescriptはどちらも、合意に基づかない音声クローニングを防ぐために、サンプルをライブで録音する必要があります。

主要な商業プレーヤーがいくつかの倫理的ガイドラインを課していることは心強いことです。ただし、これらの企業はこのテクノロジーの門番ではないことを覚えておくことが重要です。すでに世の中には多くのオープンソースツールがあり、ルールはありません。 Henry Ajderによると、脅威インテリジェンスの責任者は ディープトレース 、それを誤用するための高度なコーディング知識も必要ありません。

「この分野での進歩の多くは、以前に公開された学術論文のオープンソース実装を使用した、GitHubなどの場所での共同作業によってもたらされました」とAjder氏は述べています。 「コーディングにある程度の熟練を持っている人なら誰でも使用できます。」

セキュリティの専門家はこれまでにこれをすべて見てきました

犯罪者は、音声の複製が可能になるずっと前に電話でお金を盗もうとしました。セキュリティの専門家は、それを検出して防止するために常に電話をかけています。警備会社 ピンドロップ 発信者が音声からだと主張している人物であるかどうかを確認することにより、銀行詐欺を阻止しようとします。 2019年だけでも、Pindropは12億の音声対話を分析し、約4億7000万ドルの不正行為を防止したと主張しています。

音声のクローンを作成する前に、詐欺師は他の多くの手法を試しました。最も簡単なのは、マークに関する個人情報を他の場所から呼び出すことでした。

「私たちの音響署名により、音の特性により、ナイジェリアのSkype電話から実際に通話が発信されていることを確認できます」とPindropのCEOであるVijayBalasubramaniyanは述べています。 「それなら、顧客がアトランタでAT&T電話を使用していることを知っていることを比較できます。」

一部の犯罪者はまた、銀行の担当者を捨てるために背景音を使用することからキャリアを作りました。

「私たちがチキンマンと呼んだ詐欺師がいて、常にオンドリがバックグラウンドで動いていました」とバラスブラマニヤンは言いました。 「そして、バックグラウンドで泣いている赤ちゃんを使って、コールセンターのエージェントを本質的に説得した女性がいます。「ねえ、私は大変な時期を過ごしています」と同情します。」

そして、女性の銀行口座を追跡する男性犯罪者がいます。

「彼らはテクノロジーを使用して声の周波数を上げ、より女性らしく聞こえます」とBalasubramaniyanは説明しました。これらは成功する可能性がありますが、「ソフトウェアが台無しになり、アルビンとチップマンクスのように聞こえることがあります。」

もちろん、音声クローニングは、この拡大し続ける戦争の最新の開発にすぎません。警備会社はすでに、少なくとも1回の槍釣り攻撃で合成オーディオを使用して詐欺師を捕まえています。

「適切な目標があれば、支払いは多額になる可能性があります」とBalasubramaniyan氏は述べています。 「それで、適切な個人の合成された声を作成するために時間を割くことは理にかなっています。」

誰かが声が偽物であるかどうかを知ることができますか?

声が偽造されているかどうかを認識することになると、良いニュースと悪いニュースの両方があります。悪い点は、音声クローンが毎日良くなっていることです。ディープラーニングシステムはよりスマートになり、作成に必要なオーディオが少なくて済む、より本格的な音声を作成しています。

あなたがこのクリップからわかるように オバマ大統領がMCレンにスタンドを取るように言った 、私たちはすでに、忠実度の高い、注意深く構築された音声モデルが人間の耳にかなり説得力のある音を出すことができるようになりました。

サウンドクリップが長いほど、何かがおかしいことに気付く可能性が高くなります。ただし、短いクリップの場合、特にその正当性を疑う理由がない場合は、合成に気付かない可能性があります。

音質がクリアであるほど、オーディオディープフェイクの兆候に気づきやすくなります。誰かがスタジオ品質のマイクに直接話しかけている場合は、よく聞くことができます。しかし、低品質の通話録音や、騒がしい駐車場のハンドヘルドデバイスでキャプチャされた会話は、評価がはるかに困難になります。

幸いなことに、人間が本物と偽物を区別するのに苦労していても、コンピュータには同じ制限がありません。幸いなことに、音声検証ツールはすでに存在します。 Pindropには、ディープラーニングシステムを相互に比較するものがあります。両方を使用して、オーディオサンプルが本来あるべき人物であるかどうかを検出します。ただし、人間がサンプル内のすべての音を出すことさえできるかどうかも調べます。

音声の品質にもよりますが、毎秒の音声には、分析可能な8,000〜50,000のデータサンプルが含まれています。

「私たちが通常探しているのは、人類の進化による発話の制約です」とBalasubramaniyanは説明しました。

たとえば、2つのボーカルサウンドは、互いに最小限の間隔で分離されます。これは、口の筋肉と声帯が自分自身を再構成できる速度のために、物理的にこれ以上速く言うことができないためです。

「シンセサイザーオーディオを見ると、時々物事を見て、こう言うことがあります。これを生成できるのは7フィートの長さの首が必要なため、人間が生成することはできませんでした。 」

「摩擦音」と呼ばれる音のクラスもあります。これらは、f、s、v、zなどの文字を発音したときに、空気が喉の狭いくびれを通過するときに形成されます。摩擦音は、ソフトウェアがノイズと区別するのに問題があるため、深層学習システムが習得するのは特に困難です。

したがって、少なくとも今のところ、音声クローニングソフトウェアは、人間が体の穴から空気を流して話す肉の袋であるという事実に悩まされています。

「ディープフェイクは非常に気まぐれだと冗談を言い続けています」とBalasubramaniyanは言いました。彼は、アルゴリズムが録音の背景ノイズから単語の終わりを区別するのは非常に難しいと説明しました。これにより、人間よりも多くの音声が続く多くの音声モデルが作成されます。

「アルゴリズムがこれが頻繁に発生することを確認すると、統計的には、人間ではなく生成されたオーディオの方が自信が持てるようになります」とBalasubramaniyan氏は述べています。

Resemble AIは、オープンソースの深層学習ツールであるResemblyzerを使用して、検出の問題にも正面から取り組んでいます。 GitHubで入手可能 。偽の声を検出し、話者認証を実行できます。

警戒が必要

将来がどうなるかを推測することは常に困難ですが、このテクノロジーはほぼ確実に改善されるだけです。また、選出された公務員や銀行のCEOなどの著名人だけでなく、誰もが被害者になる可能性があります。

「私たちは、人々の声が盗まれる最初の音声侵害の危機に瀕していると思います」とBalasubramaniyanは予測しました。

ただし、現時点では、オーディオディープフェイクによる実際のリスクは低いです。合成ビデオを検出するのにかなり良い仕事をしているように見えるツールがすでにあります。

さらに、ほとんどの人は攻撃のリスクにさらされていません。 Ajder氏によると、主要な商用プレーヤーは「特定のクライアント向けに特注のソリューションに取り組んでおり、ほとんどのプレーヤーは、誰と協力するか、誰と協力しないかについて、かなり優れた倫理ガイドラインを持っています」。

しかし、Ajderが次のように説明しているように、本当の脅威は先にあります。

「パンドラの箱は、テクノロジーのオープンソース実装を組み合わせて、現在の商用ソリューションのような倫理的な精査がない、ますますユーザーフレンドリーでアクセスしやすいアプリやサービスにする人々です。」

これはおそらく避けられないことですが、セキュリティ会社はすでに偽のオーディオ検出をツールキットに組み込んでいます。それでも、安全を保つには警戒が必要です。

「これは他のセキュリティ分野でも行っています」とAjder氏は述べています。 「たとえば、多くの組織は、次のゼロデイ脆弱性を理解しようと多くの時間を費やしています。合成オーディオは、単に次のフロンティアです。」