ویڈیو ڈیف فیکس کا مطلب ہے کہ آپ اپنی ہر چیز پر اعتماد نہیں کرسکتے ہیں۔ اب ، آڈیو ڈیف فیکس کا مطلب ہوسکتا ہے کہ آپ اپنے کانوں پر مزید اعتماد نہیں کرسکتے ہیں۔ کیا واقعی یہ صدر کینیڈا کے خلاف جنگ کا اعلان کر رہے تھے؟ کیا واقعی آپ کے والد فون پر اس کا ای میل پاس ورڈ مانگ رہے ہیں؟

اس فہرست میں ایک اور وجودی پریشانی شامل کریں کہ ہمارا اپنا حب کیسے لامحالہ ہمیں تباہ کرسکتا ہے۔ ریگن عہد کے دوران ، صرف حقیقی تکنیکی خطرہ جوہری ، کیمیائی اور حیاتیاتی جنگ کا خطرہ تھا۔

اگلے سالوں میں ، ہمیں نینو ٹیک کے گرے گو اور عالمی وبائی بیماریوں کے بارے میں جنون کا موقع ملا۔ اب ، ہمارے پاس ڈیف فیکس ہیں - لوگ اپنی مشابہت یا آواز پر قابو پاتے ہیں۔

ایک آڈیو ڈیفیک کیا ہے؟

ہم میں سے بیشتر نے دیکھا ہے ایک ویڈیو ڈیفیک ، جس میں گہری سیکھنے والے الگورتھم ایک شخص کی جگہ کسی اور کی مثال کے ساتھ استعمال ہوتے ہیں۔ بہترین حیرت انگیز حقیقت پسند ہیں ، اور اب اس کی باری آڈیو کی ہے۔ ایک آڈیو ڈپ فیک اس وقت ہوتی ہے جب ایک "کلون" آواز جو ممکنہ طور پر حقیقی شخص کی مماثل نہیں ہوتی مصنوعی آڈیو تیار کرنے کے لئے استعمال کی جاتی ہے۔

سی ای او کے سی ای او زوہیب احمد نے کہا ، "یہ آواز کے لئے فوٹوشاپ کی طرح ہے۔" AI سے مشابہت رکھتے ہیں ، اپنی کمپنی کی صوتی کلوننگ ٹیکنالوجی کے بارے میں۔

تاہم ، فوٹوشاپ کی خراب نوکریاں آسانی سے ختم ہوجاتی ہیں۔ ایک سیکیورٹی فرم جس کے ساتھ ہم نے بات کی تھی ، لوگ عام طور پر صرف اس بات کا اندازہ لگاتے ہیں کہ اگر کوئی آڈیو ڈیف فیک 57 فیصد درستگی کے ساتھ حقیقی ہے یا جعلی۔

مزید برآں ، کیوں کہ بہت ساری آواز کی ریکارڈنگ کم کوالٹی فون کالز کی ہے (یا شور والے مقامات پر ریکارڈ کی گئی ہے) ، لہذا آڈیو ڈیف فیکس کو اور بھی تمیز نہیں کیا جاسکتا ہے۔ آواز کا معیار جتنا خراب ہے ، ان لوگوں کو بتانا مشکل ہے کہ آواز حقیقی نہیں ہے۔

لیکن کیوں بھی ، کسی کو بھی آوازوں کے ل Photos فوٹو شاپ کی ضرورت ہوگی؟

مصنوعی آڈیو کے لئے مجبوری کیس

مصنوعی آڈیو کے لئے دراصل ایک بہت بڑا مطالبہ ہے۔ احمد کے مطابق ، "آر اوآئی بہت فوری ہے۔"

یہ خاص طور پر سچ ہے جب یہ گیمنگ کی بات آتی ہے۔ ماضی میں ، تقریر ایک کھیل میں ایک جزو ہوتا تھا جس کی وجہ سے طلب کو پیدا کرنا ناممکن تھا۔ یہاں تک کہ حقیقی وقت میں پیش کردہ سنیما کے معیار کے مناظر کے ساتھ انٹرایکٹو عنوانات میں ، نان پلے کرداروں کے ساتھ زبانی تعامل ہمیشہ لازمی طور پر مستحکم ہوتا ہے۔

اب ، اگرچہ ، ٹیکنالوجی نے اپنی گرفت میں لے لی ہے۔ اسٹوڈیوز میں ایک اداکار کی آواز کو کلون کرنے اور ٹیکسٹ ٹو اسپیچ انجنوں کا استعمال کرنے کی صلاحیت ہے تاکہ حرف حقیقی وقت میں کچھ بھی کہہ سکیں۔

ایڈورٹائزنگ ، اور ٹیک اور کسٹمر سپورٹ میں بھی روایتی استعمال زیادہ ہیں۔ یہاں ، ایک ایسی آواز جو صداقت سے انسانی لگتی ہے اور انسانی ان پٹ کے بغیر ذاتی طور پر اور سیاق و سباق کا جواب دیتی ہے وہی اہم ہے۔

وائس کلوننگ کمپنیاں بھی طبی درخواستوں کے بارے میں پرجوش ہیں۔ یقینا، آواز کی تبدیلی طب میں کوئی نئی بات نہیں ہے — اسٹیفن ہاکنگ نے 1985 میں اپنی کھو جانے کے بعد مشہور روبوٹک ترکیب کی آواز کا استعمال کیا۔ تاہم ، جدید آواز کا کلوننگ اس سے بھی بہتر کچھ کا وعدہ کرتا ہے۔

سن 2008 میں مصنوعی آواز کمپنی ، سیرپروک ، دیر سے فلم نقاد ، راجر ایبرٹ ، نے کینسر کے خاتمے کے بعد اس کی آواز واپس کردی۔ سیرپروک نے ایک ویب صفحہ شائع کیا تھا جس میں لوگوں کو ایسے پیغامات ٹائپ کرنے کی اجازت دی گئی تھی جو اس کے بعد سابق صدر جارج بش کی آواز میں بولے جائیں گے۔

سیبرپروک کے چیف سائنسی آفیسر میتھیو آیلیٹ نے کہا ، "البرٹ نے یہ دیکھا اور سوچا ، 'ٹھیک ہے ، اگر وہ بش کی آواز کو نقل کرسکتے ہیں تو ، وہ میری نقل کرنے کے اہل ہوں گے۔' اس کے بعد ایبرٹ نے کمپنی سے متبادل کی آواز پیدا کرنے کو کہا ، جو انہوں نے وائس ریکارڈنگ کی ایک بڑی لائبریری پر کارروائی کرکے کیا۔

آیلیٹ نے کہا ، "کسی نے بھی ایسا پہلی بار کیا تھا اور یہ ایک حقیقی کامیابی تھی۔"

حالیہ برسوں میں ، متعدد کمپنیوں (بشمول سیرپروک) نے کمپنی کے ساتھ کام کیا ہے ALS ایسوسی ایشن پر پروجیکٹ رسائ ALS میں مبتلا افراد کو مصنوعی آواز فراہم کرنا۔

مصنوعی آڈیو کس طرح کام کرتا ہے

وائس کلوننگ میں ابھی ایک لمحہ گزر رہا ہے ، اور بہت سی کمپنیاں ٹول تیار کر رہی ہیں۔ AI سے مشابہت رکھتے ہیں اور تفصیل آن لائن ڈیمو ہے جو بھی مفت میں آزما سکتا ہے۔ آپ صرف ان جملے کو ریکارڈ کرتے ہیں جو اسکرین پر ظاہر ہوتے ہیں اور ، کچھ ہی منٹوں میں آپ کی آواز کا ایک نمونہ تشکیل پایا جاتا ہے۔

آپ اے آئی کا شکریہ ادا کرسکتے ہیں — خاص طور پر ، گہری سیکھنے الگورتھم — آپ کی آواز بنانے والے جزو والے فونز کو سمجھنے کے لئے ریکارڈ شدہ تقریر کو ٹیکسٹ سے میل کرنے کے قابل ہوسکتے ہیں۔ اس کے بعد یہ نتیجے میں لسانی عمارت کے بلاکس کو ان الفاظ کے ل words استعمال کرتا ہے جو اس نے آپ کو بولتے نہیں سنا ہے۔

بنیادی ٹکنالوجی تھوڑی دیر کے لئے رہی ہے ، لیکن جیسا کہ آیلیٹ نے بتایا ، اس کے لئے کچھ مدد درکار ہے۔

انہوں نے کہا ، "آواز کاپی کرنا پیسٹری بنانے کے مترادف تھا۔" "یہ کرنا ایک طرح کا مشکل کام تھا اور اس کے کام کرنے کے ل various آپ کو ہاتھ سے چمکانے کے مختلف طریقے تھے۔"

قابل عمل نتائج حاصل کرنے کے لئے ڈویلپرز کو بہت زیادہ مقدار میں ریکارڈ شدہ صوتی ڈیٹا کی ضرورت ہوتی ہے۔ پھر ، کچھ سال پہلے ، سیلاب کے راستے کھل گئے۔ کمپیوٹر وژن کے شعبے میں ہونے والی تحقیقات اہم ثابت ہوئی۔ سائنس دانوں نے جنریٹو اڈورشیئل نیٹ ورک (GANs) تیار کیے ، جو موجودہ اعداد و شمار کی بنیاد پر پہلی بار ، اخراج اور پیش گوئیاں کرسکتے ہیں۔

آیلیٹ نے کہا ، "کسی گھوڑے کی تصویر دیکھنے اور یہ کہنے کے لئے کہ یہ’ ’یہ ایک گھوڑا ہے‘ ‘کے کمپیوٹر کے بجائے ، میرا ماڈل اب گھوڑے کو زیبرا بنا سکتا ہے۔ "لہذا ، اب تقریر کی ترکیب میں ہونے والا دھماکہ کمپیوٹر وژن کے علمی کام کی بدولت ہے۔"

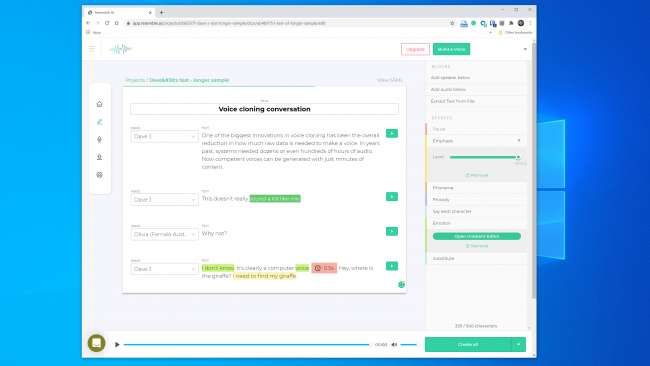

صوتی کلوننگ میں سب سے بڑی بدعات میں سے ایک مجموعی کمی ہے کہ آواز بنانے کے لئے کتنے خام ڈیٹا کی ضرورت ہے۔ ماضی میں ، نظاموں کو درجنوں یا اس سے بھی سیکڑوں گھنٹے آڈیو کی ضرورت ہوتی تھی۔ تاہم ، اب کچھ منٹ کے مشمولات سے قابل آوازیں پیدا کی جاسکتی ہیں۔

متعلقہ: اے آئی کے ساتھ مسئلہ: مشینیں چیزیں سیکھ رہی ہیں ، لیکن ان کو سمجھ نہیں سکتی ہیں

کسی بھی چیز پر اعتبار نہ کرنے کا وجودی خوف

ایٹمی بجلی ، نانوٹیک ، تھری ڈی پرنٹنگ اور سی آر آئی ایس پی آر کے ساتھ یہ ٹیکنالوجی بیک وقت سنسنی خیز اور خوفناک ہے۔ بہر حال ، لوگوں کے وائس کلونوں کے ذریعہ دھوکہ دہی کی خبروں میں پہلے ہی ایسے واقعات پیش آ چکے ہیں۔ 2019 میں ، امریکہ میں ایک کمپنی نے دعوی کیا کہ یہ ہے آڈیو ڈیفیک کے ذریعہ دھوکہ دہی جرائم پیشہ افراد کو وائرنگ کے پیسوں میں فون کال۔

حیرت انگیز طور پر قائل آڈیو فیکس کو تلاش کرنے کے ل You آپ کو زیادہ دور نہیں جانا پڑے گا۔ یوٹیوب چینل آواز ترکیب معروف لوگوں کو ایسی باتیں کہتے ہیں جو انہوں نے کبھی نہیں کہا ، جیسے جارج ڈبلیو بش 50 سنٹ تک "ان کلب میں" پڑھ رہے ہیں . یہ اسپاٹ ہے۔

یوٹیوب پر کہیں بھی ، آپ سابق صدور سمیت ایک ریوڑ بھی سن سکتے ہیں اوبامہ ، کلنٹن ، اور ریگن ، NWA کو چھاپ رہے ہیں . موسیقی اور پس منظر کی آوازیں کچھ واضح روبوٹک چمک کو چھپانے میں مدد کرتی ہیں ، لیکن اس نامکمل حالت میں بھی ، اس کی صلاحیت واضح ہے۔

ہم نے ٹولز پر تجربہ کیا AI سے مشابہت رکھتے ہیں اور تفصیل اور صوتی کلون پیدا کیا۔ اسکرپٹ میں صوتی کلوننگ انجن استعمال کیا گیا ہے جسے اصل میں لئیربرڈ کہا جاتا تھا اور خاص طور پر متاثر کن تھا۔ ہم معیار پر حیران تھے۔ آپ کی اپنی آواز سن کر ایسی باتیں کہی جائیں جو آپ جانتے ہو کہ آپ نے کبھی نہیں کہا ہے۔

تقریر میں یقینی طور پر ایک روبوٹک معیار موجود ہے ، لیکن محض سننے پر ، زیادہ تر لوگوں کے پاس یہ سمجھنے کی کوئی وجہ نہیں ہوگی کہ یہ جعلی تھا۔

ہم سے ملتے جلتے AI سے بھی زیادہ امیدیں وابستہ تھیں۔ یہ آپ کو متعدد آوازوں کے ساتھ بات چیت پیدا کرنے کے لئے ٹولز فراہم کرتا ہے اور ڈائیلاگ کے اظہار ، جذبات اور پیکنگ میں مختلف ہوتا ہے۔ تاہم ، ہم یہ نہیں سوچتے تھے کہ صوتی ماڈل نے ہماری استعمال کردہ آواز کی بنیادی خصوصیات کو حاصل کرلیا۔ در حقیقت ، کسی کو بیوقوف بنانا اس کا امکان نہیں تھا۔

ایک مشابہت آیی نمائندہ نے ہمیں بتایا "زیادہ تر لوگ نتائج سے اڑا دیتے ہیں اگر وہ اسے صحیح طریقے سے کرتے ہیں۔" ہم نے دو بار اسی طرح کے نتائج کے ساتھ ایک وائس ماڈل بنایا۔ لہذا ، ظاہر ہے ، صوتی کلون بنانا ہمیشہ آسان نہیں ہوتا ہے جسے آپ ڈیجیٹل ہسٹ کو دور کرنے کے لئے استعمال کرسکتے ہیں۔

اس کے باوجود ، لائیر برڈ (جو اب ڈسکرپٹ کا حصہ ہے) کے بانی ، کندن کمار ، محسوس کرتے ہیں کہ ہم اس دہلیز کو پہلے ہی گزر چکے ہیں۔

کمار نے کہا ، "تھوڑی فیصد معاملات میں ، وہ پہلے ہی موجود ہے۔ "اگر میں کسی تقریر میں کچھ الفاظ تبدیل کرنے کے لئے مصنوعی آڈیو استعمال کرتا ہوں تو ، یہ پہلے ہی اتنا اچھا ہے کہ آپ کو کیا جاننے میں مشکل ہوگی۔"

ہم یہ بھی فرض کرسکتے ہیں کہ وقت کے ساتھ ہی یہ ٹیکنالوجی بہتر ہوگی۔ سسٹم کو ماڈل بنانے کے لئے کم آڈیو کی ضرورت ہوگی ، اور تیز رفتار پروسیسر اصلی وقت میں ماڈل کی تشکیل کرسکیں گے۔ ہوشیار اے آئی سیکھے گی کہ انسان کی طرح کا قائل اور تقریر پر زور دینے سے کس طرح کام کرنے کی مثال نہیں مل سکتی ہے۔

اس کا مطلب ہے کہ ہم آسانی سے وائس کلوننگ کی وسیع پیمانے پر دستیابی کے قریب پہنچ رہے ہیں۔

پنڈورا باکس کے اخلاقیات

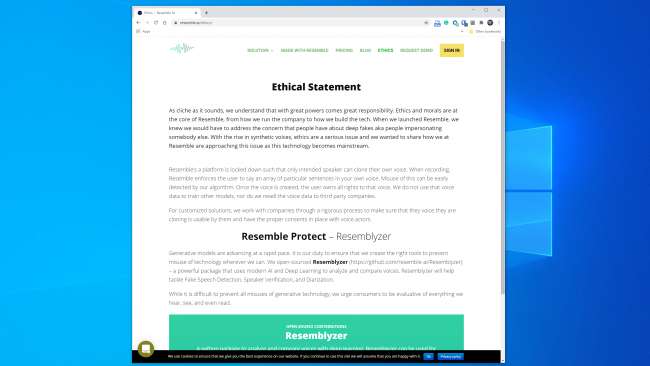

اس جگہ میں کام کرنے والی زیادہ تر کمپنیاں محفوظ ، ذمہ دارانہ انداز میں ٹکنالوجی کو سنبھالنے کے لئے تیار ہیں۔ مثال کے طور پر ، AI سے ملتا ہے اپنی ویب سائٹ پر ایک پورا "اخلاقیات" سیکشن ، اور مندرجہ ذیل اقتباس حوصلہ افزا ہے:

"ہم ایک سخت عمل کے ذریعے کمپنیوں کے ساتھ مل کر کام کرتے ہیں تاکہ یہ یقینی بنائے کہ وہ جس آواز کو کلون کر رہے ہیں وہ ان کے ذریعہ قابل استعمال ہے اور ہم آواز کے اداکاروں کے ساتھ مناسب رضامند ہیں۔"

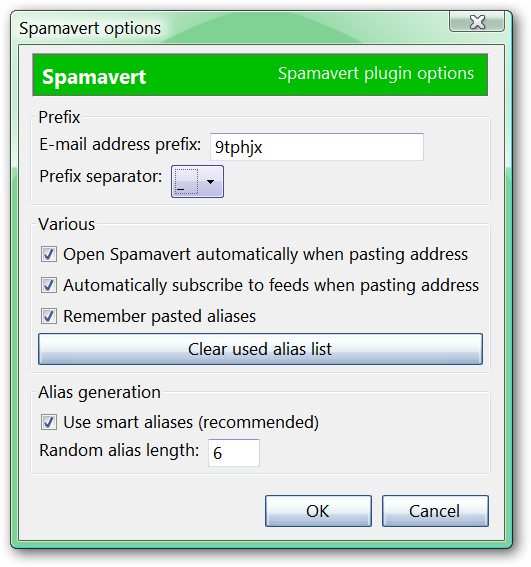

اسی طرح ، کمار نے کہا کہ لائیربرڈ شروع سے ہی غلط استعمال پر تشویش میں مبتلا تھے۔ اسی لئے اب ، اسکرپٹ کے ایک حصے کے طور پر ، یہ صرف لوگوں کو اپنی آواز کو کلون کرنے کی اجازت دیتا ہے۔ درحقیقت ، مشابہت اور وضاحت دونوں طرح کی ضرورت ہوتی ہے کہ لوگ غیر نمونہ وائس کلوننگ کو روکنے کے لئے اپنے نمونوں کو براہ راست ریکارڈ کریں۔

یہ خوشی کی بات ہے کہ بڑے تجارتی کھلاڑیوں نے کچھ اخلاقی رہنما خطوط عائد کردی ہیں۔ تاہم ، یہ یاد رکھنا ضروری ہے کہ یہ کمپنیاں اس ٹکنالوجی کے دروازے نہیں ہیں۔ جنگل میں پہلے ہی بہت سارے اوپن سورس ٹولز موجود ہیں ، جن کے لئے کوئی اصول نہیں ہیں۔ خطرہ انٹیلیجنس کے سربراہ ہنری اجڈر کے مطابق ڈیپ ٹریس ، آپ کو اس کے غلط استعمال کے ل advanced اعلی درجے کی کوڈنگ علم کی ضرورت نہیں ہے۔

اجر نے کہا ، "خلا میں بہت سی پیشرفت گیٹ ہب جیسی جگہوں پر باہمی تعاون کے ساتھ ہوئی ہے ، اس سے پہلے شائع شدہ تعلیمی کاغذات پر اوپن سورس عملدرآمد کا استعمال کیا گیا ہے۔" "اس کا استعمال ہر وہ شخص کرسکتا ہے جسے کوڈنگ میں اعتدال پسندانہ مہارت حاصل ہو۔"

سیکیورٹی پیشہ یہ سب پہلے دیکھ چکا ہے

وائس کلوننگ ممکن ہونے سے بہت پہلے مجرموں نے فون کے ذریعہ رقم چوری کرنے کی کوشش کی تھی ، اور سکیورٹی ماہرین ہمیشہ اس کا پتہ لگانے اور روکنے کے لئے فون کرتے رہے ہیں۔ سیکیورٹی کمپنی Pindrop اگر کوئی کال کرنے والا آڈیو سے ہونے کا دعوی کرتا ہے تو یہ تصدیق کرکے بینک فراڈ کو روکنے کی کوشش کرتا ہے۔ صرف 2019 میں ، پنڈروپ نے 1.2 ارب صوتی تعامل کا تجزیہ کرنے کا دعوی کیا ہے اور فراڈ کی کوششوں میں تقریبا in 470 ملین ڈالر کی روک تھام کی ہے۔

وائس کلوننگ سے پہلے ، دھوکہ دہی کرنے والوں نے متعدد دوسری تکنیکوں کو آزمایا۔ اس نشان کے بارے میں ذاتی معلومات کے ساتھ آسان ترین جگہ سے کہیں اور فون کررہا تھا۔

"ہمارے صوتی دستخط سے ہمیں یہ معلوم کرنے کی اجازت ملتی ہے کہ صوتی خصوصیات کی وجہ سے نائیجیریا میں واقعی اسکائپ فون سے کال آرہی ہے۔" "پھر ، ہم موازنہ کرسکتے ہیں کہ صارف کو جاننے سے اٹلانٹا میں اے ٹی اینڈ ٹی فون استعمال ہوتا ہے۔"

کچھ جرائم پیشہ افراد نے بینکاری نمائندوں کو دور کرنے کے لئے پس منظر کی آوازیں استعمال کرنے سے بھی کیریئر بنا لیا ہے۔

بالسوبرمانیان نے کہا ، "ایک دھوکہ دہندہ ہے جسے ہم نے چکن مین کہا ہے جس کے پس منظر میں ہمیشہ مرغے جاتے تھے۔" "اور ایک خاتون ہیں جنہوں نے کال سنٹر کے ایجنٹوں کو بنیادی طور پر راضی کرنے کے لئے پس منظر میں روتے ہوئے بچے کو استعمال کیا ، کہ" ارے ، میں ایک مشکل وقت سے گزر رہا ہوں "ہمدردی حاصل کرنے کے لئے۔"

اور پھر ایسے مرد مجرم ہیں جو خواتین کے بینک اکاؤنٹس کے پیچھے جاتے ہیں۔

بالسوبرمانیان نے وضاحت کرتے ہوئے کہا ، "وہ اپنی آواز کی فریکوئینسی بڑھانے اور زیادہ نسائی آواز کے ل technology ٹکنالوجی کا استعمال کرتے ہیں۔ یہ کامیاب ہوسکتے ہیں ، لیکن "کبھی کبھار ، سافٹ ویئر خراب ہوجاتا ہے اور وہ ایلون اور چپپونک کی طرح آواز آتے ہیں۔"

بے شک ، وائس کلوننگ اس بڑھتی ہوئی جنگ کی صرف تازہ ترین ترقی ہے۔ حفاظتی فرموں نے کم از کم ایک نیزہ سازی کے حملے میں مصنوعی آڈیو استعمال کرنے والے جعلسازوں کو پہلے ہی پکڑا ہے۔

بالسوبرمانیان نے کہا ، "صحیح ہدف کے ساتھ ، ادائیگی بڑے پیمانے پر ہوسکتی ہے۔ "لہذا ، یہ صحیح معنیٰ میں ہے کہ صحیح فرد کی ترکیب آواز پیدا کرنے کے لئے وقت کو مختص کیا جائے۔"

کیا کوئی بتا سکتا ہے کہ کوئی آواز جعلی ہے؟

جب یہ پہچاننے کی بات آتی ہے کہ آیا کوئی آواز جعلی ہوگئی ہے تو ، اچھی اور بری دونوں خبریں موجود ہیں۔ برا یہ ہے کہ ہر روز صوتی کلونز بہتر ہو رہے ہیں۔ گہری سیکھنے کے نظام بہتر ہو رہے ہیں اور زیادہ مستند آوازیں بن رہے ہیں جن کو بنانے کے لئے کم آڈیو کی ضرورت ہے۔

جیسا کہ آپ اس کلپ سے بتا سکتے ہیں صدر اوباما ایم سی رین کو موقف اختیار کرنے کو کہتے ہیں ، ہم پہلے ہی اس مقام پر پہنچ چکے ہیں جہاں ایک اعلی مخلص ، احتیاط سے تیار کردہ صوتی نمونہ انسانی کان کے لئے کافی حد تک قائل محسوس کرسکتا ہے۔

جتنا طویل صوتی کلپ ہے ، آپ کو اس میں کہیں زیادہ خرابی محسوس ہونے کا امکان ہے۔ اگرچہ مختصر تراشوں کے ل you ، آپ کو شاید یہ مصنوعی نظر نہیں آتا ہے. خاص طور پر اگر آپ کے پاس اس کی قانونی حیثیت پر سوال کرنے کی کوئی وجہ نہیں ہے۔

صوتی معیار جتنا صاف ہوگا ، آڈیو ڈیف فیک کے آثار دیکھنا اتنا ہی آسان ہے۔ اگر کوئی براہ راست اسٹوڈیو کے معیار والے مائکروفون میں بات کر رہا ہے تو آپ قریب سے سننے کے قابل ہوں گے۔ لیکن شور کی جگہ پر پارکنگ گیراج میں ہینڈ ہیلڈ والے آلہ پر ناقص معیار کی فون کال ریکارڈنگ یا گفتگو کی گرفت کا اندازہ کرنا زیادہ مشکل ہوگا۔

خوشخبری ہے ، یہاں تک کہ اگر انسانوں کو اصلی کو جعلی سے الگ کرنے میں تکلیف ہو ، کمپیوٹرز میں ایسی حدود نہیں ہیں۔ خوش قسمتی سے ، آواز کی توثیق کے اوزار پہلے سے موجود ہیں۔ پنڈروپ کے پاس ایک ہے جو ایک دوسرے کے خلاف گہرائی سے سیکھنے کے نظام کو کھودتا ہے۔ یہ دونوں کو دریافت کرنے کے لئے استعمال کرتا ہے کہ آیا آڈیو نمونہ وہ شخص ہے جس کا اسے سمجھا جانا چاہئے۔ تاہم ، یہ بھی جانچ پڑتال کرتا ہے کہ آیا انسان نمونے میں بھی ساری آوازیں بنا سکتا ہے۔

آڈیو کے معیار پر منحصر ہے ، ہر سیکنڈ تقریر میں 8،000-50،000 ڈیٹا کے نمونے ہوتے ہیں جن کا تجزیہ کیا جاسکتا ہے۔

بالسوبرمانیان نے وضاحت کی ، "جن چیزوں کی ہم عام طور پر تلاش کرتے ہیں وہ انسانی ارتقا کی وجہ سے تقریر میں رکاوٹیں ہیں۔

مثال کے طور پر ، دو مخر آوازوں میں ایک دوسرے سے کم از کم ممکن علیحدگی ہوتی ہے۔ اس کی وجہ یہ ہے کہ جسمانی طور پر ان کے بارے میں تیز رفتار سے کہنا ممکن نہیں ہے جس کی وجہ سے آپ کے منہ اور مخر ڈوروں میں پٹھوں کی تشکیل خود ہوسکتی ہے۔

بالسوبرمانیان نے کہا ، "جب ہم ترکیب شدہ آڈیو کو دیکھتے ہیں تو ،" ہم کبھی کبھی چیزیں دیکھتے ہیں اور کہتے ہیں ، 'یہ کبھی بھی انسان پیدا نہیں کرسکتا تھا کیونکہ واحد شخص جس نے اسے پیدا کیا ہو اسے سات فٹ لمبی گردن کی ضرورت ہوتی ہے۔ "

آواز کی ایک کلاس بھی ہے جسے "فرائکیٹیز" کہتے ہیں۔ جب آپ ایف ، ایس ، وی ، اور زیڈ جیسے خطوط کا تلفظ کرتے ہیں تو آپ کے حلق میں ہوا کی تنگی سے گزرتے وقت وہ تشکیل پاتے ہیں۔ گہری سیکھنے والے سسٹم میں مہارت حاصل کرنے کے ل F Fricatives خاص طور پر سخت ہیں کیونکہ سافٹ ویئر کو شور سے ان کو مختلف کرنے میں پریشانی ہے۔

لہذا ، کم از کم ابھی تک ، وائس کلوننگ سافٹ ویئر اس حقیقت سے ٹھوکر کھا رہا ہے کہ انسان گوشت کے تھیلے ہیں جو بات کرنے کے ل their اپنے جسم کے سوراخوں سے ہوا میں بہہ جاتے ہیں۔

بالسوبرمانیان نے کہا ، "میں یہ مذاق کرتا رہتا ہوں کہ گہری کھانوں میں بہت پیاری ہوتی ہے۔" انہوں نے وضاحت کی کہ الگورتھم کے لئے ریکارڈنگ میں پس منظر کے شور سے الفاظ کے اختتام کی تمیز کرنا بہت مشکل ہے۔ اس کا نتیجہ بہت سارے صوتی ماڈلز کے ساتھ ہوتا ہے جس میں تقریر ہوتی ہے جو انسانوں کی نسبت زیادہ پگڈنڈی کرتی ہے۔

بالسوبرمانیان نے کہا ، "جب ایک الگورتھم دیکھتا ہے کہ یہ بہت کچھ ہورہا ہے ،" اعدادوشمار کے مطابق ، یہ زیادہ پر اعتماد ہوجاتا ہے کہ یہ آڈیو ہے جو انسان کی مخالفت میں تیار کیا گیا ہے۔ "

مماثل اے ، ریساوزرزر ، ایک اوپن سورس ڈرا لرننگ ٹول کے ذریعہ بھی سراغ لگانے کے مسئلے سے نمٹ رہا ہے گٹ ہب پر دستیاب ہے . یہ جعلی آوازوں کا پتہ لگانے اور اسپیکر کی توثیق کرسکتا ہے۔

یہ چوکسی لیتا ہے

مستقبل میں کیا ہوسکتا ہے اس کا اندازہ لگانا ہمیشہ مشکل ہے ، لیکن یہ ٹیکنالوجی تقریبا only بہتر طور پر ہی بہتر ہوگی۔ نیز ، کوئی بھی ممکنہ طور پر شکار ہوسکتا ہے - نہ صرف اعلی سطحی افراد ، بلکہ منتخب عہدیداروں یا بینکنگ سی ای اوز کی طرح۔

بالسوبرمانیان نے پیش گوئی کی ، "مجھے لگتا ہے کہ ہم پہلی آڈیو خلاف ورزی کے دہانے پر ہیں جہاں لوگوں کی آوازیں چوری ہوجاتی ہیں۔"

اس وقت ، اگرچہ ، آڈیو ڈیف فیکس سے حقیقی دنیا کا خطرہ کم ہے۔ پہلے ہی ایسے اوزار موجود ہیں جو مصنوعی ویڈیو کا پتہ لگانے کے لئے ایک عمدہ کام انجام دیتے ہیں۔

اس کے علاوہ ، زیادہ تر لوگوں کو حملے کا خطرہ نہیں ہے۔ اجدیر کے مطابق ، اہم تجارتی کھلاڑی "مخصوص مؤکلوں کے لئے بیسپوک حل پر کام کر رہے ہیں ، اور بیشتر کے پاس اخلاقیات کی اچھی راہنمائی موجود ہے کہ وہ کس کے ساتھ کام کریں گے اور نہیں۔"

اصل خطرہ آگے ہے ، حالانکہ ، جیسا کہ اجر نے وضاحت کی:

"پنڈورا باکس میں وہ لوگ ہوں گے جو تیزی سے صارف دوست ، قابل رسا ایپس یا خدمات میں ٹکنالوجی کے اوپن سورس کے نفاذ کے ساتھ مل کر کام کریں گے جس کی جانچ پڑتال کی اس قسم کی اخلاقی پرت نہیں ہے جو اس وقت تجارتی حل کرتی ہے۔"

یہ شاید ناگزیر ہے ، لیکن سیکیورٹی کمپنیاں جعلی آڈیو سراغ لگانے کو پہلے ہی اپنے ٹول کٹس میں لے رہی ہیں۔ پھر بھی ، محفوظ رہنے کیلئے چوکسی کی ضرورت ہے۔

"ہم نے یہ کام دوسرے سیکیورٹی علاقوں میں کیا ہے۔" مثال کے طور پر ، "بہت سی تنظیمیں اگلی صفر دن کی کمزوری کیا ہے کو سمجھنے کی کوشش میں بہت وقت خرچ کرتی ہیں۔ مصنوعی آڈیو محض اگلی سرحد ہے۔