Glem at købe et dedikeret grafikkort, snart vil du spille uden et. I det mindste, hvis du er en del af 90% af befolkningen der stadig spiller på 1080p eller derunder. Nylige fremskridt fra både Intel og AMD betyder, at deres integrerede GPU'er er ved at rive op i markedet for low-end grafikkort.

Hvorfor er iGPU'erne så langsomme i første omgang?

Der er to grunde: hukommelse og dørstørrelse.

Hukommelsesdelen er let at forstå: hurtigere hukommelse er lig med bedre ydelse. iGPU'er får dog ikke fordelene ved fancy hukommelsesteknologier som GDDR6 eller HBM2, og skal i stedet stole på at dele systemets RAM med resten af computeren. Dette skyldes for det meste, at det er dyrt at lægge den hukommelse på selve chippen, og iGPU'er er normalt målrettet mod budgetgamere. Dette ændrer sig ikke når som helst snart, i det mindste ikke fra det, vi kender nu, men forbedring af hukommelsescontrollere, der muliggør hurtigere RAM, kan forbedre næste generations iGPU-ydeevne.

Den anden grund, dørstørrelse, er, hvad der ændrer sig i 2019. GPU-matricer er store - langt større end CPU'er, og store matricer er dårlig forretning for siliciumproduktion. Dette kommer ned til mangelfrekvensen. Et større område har større chance for mangler, og en defekt i matricen kan betyde, at hele CPU'en er skål.

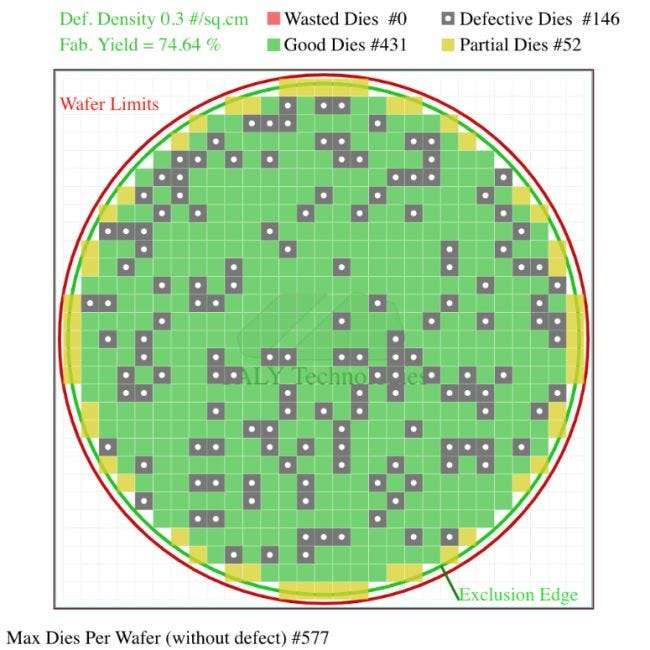

Du kan se i dette (hypotetiske) eksempel nedenfor, at en fordobling af matricestørrelsen resulterer i et meget lavere udbytte, fordi hver defekt lander i et meget større område. Afhængigt af hvor fejlene opstår, kan de gøre en hel CPU værdiløs. Dette eksempel er ikke overdrevet for effekt; afhængigt af CPU'en kan den integrerede grafik tage næsten halvdelen af matricen.

Die space sælges til forskellige komponentproducenter til en meget høj præmie, så det er svært at retfærdiggøre at investere masser af plads i en meget bedre iGPU, når denne plads kan bruges til andre ting som øget kernetælling. Det er ikke, at teknologien ikke er der; hvis Intel eller AMD ønskede at lave en chip, der var 90% GPU, kunne de, men deres udbytter med et monolitisk design ville være så lave, at det ikke engang ville være det værd.

Enter: Chiplets

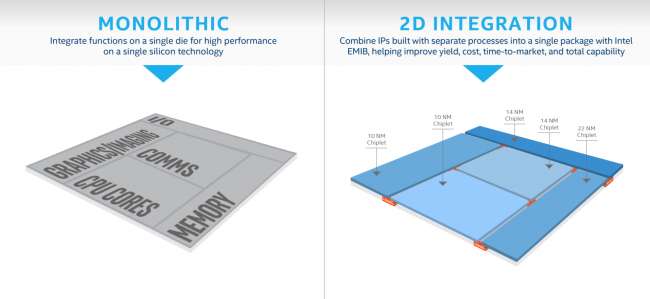

Intel og AMD har vist deres kort, og de er meget ens. Med de nyeste procesknudepunkter, der har højere mangelfrekvenser end normalt, har både Chipzilla og det røde hold valgt at skære deres matricer op og lim dem sammen igen i posten. De gør det hver lidt anderledes, men i begge tilfælde betyder det, at matricestørrelsesproblemet ikke længere er et problem, da de kan fremstille chippen i mindre, billigere stykker og derefter samle dem igen, når den er pakket i faktisk CPU.

I Intels tilfælde ser det ud til at være en omkostningsbesparende foranstaltning. Det ser ikke ud til at ændre deres arkitektur meget, bare lade dem vælge, hvilken node de skal fremstille hver del af CPU'en på. De ser imidlertid ud til at have planer om at udvide iGPU, som den kommende Gen11-model har “64 forbedrede eksekveringsenheder, mere end fordoblet tidligere Intel Gen9-grafik (24 EU'er), designet til at bryde 1 TFLOPS-barrieren” . En enkelt TFLOP-ydeevne er ikke rigtig så meget, da Vega 11-grafikken i Ryzen 2400G har 1,7 TFLOPS, men Intels iGPU'er har notorisk set haltet bag AMD's, så enhver indhentning er en god ting.

Ryzen APU'er kunne dræbe markedet

AMD ejer Radeon, den næststørste GPU-producent, og bruger dem i deres Ryzen APU'er. Når man ser på deres kommende teknologi, lover det meget godt for dem, især med forbedringer på 7 nm rundt om hjørnet. Der er rygtet om, at deres kommende Ryzen-chips bruger chiplets, men forskelligt fra Intel. Deres chipletter er helt separate matricer, der er forbundet over deres multifunktionelle "Infinity Fabric" -forbindelse, hvilket giver mere modularitet end Intels design (på bekostning af lidt øget ventetid). De har allerede brugt chiplets med stor effekt med deres 64-core Epyc CPU'er, der blev annonceret tidligt i november.

Ifølge nogle nylige lækager , AMDs kommende Zen 2-serie inkluderer 3300G, en chip med en otte-core CPU-chiplet og en Navi 20-chiplet (deres kommende grafiske arkitektur). Hvis dette viser sig at være sandt, kan denne enkelt chip erstatte grafikkort på indgangsniveau. 2400G med Vega 11-computerenheder får allerede afspilbare billedhastigheder i de fleste spil på 1080p, og 3300G har angiveligt næsten dobbelt så mange computerenheder såvel som at være i en nyere, hurtigere arkitektur.

Dette er ikke kun formodninger; det giver meget mening. Den måde, hvorpå deres design er udformet, giver AMD mulighed for at forbinde stort set ethvert antal chiplets, hvor de eneste begrænsende faktorer er magten og pladsen på pakken. De bruger næsten helt sikkert to chipletter pr. CPU, og alt hvad de skulle gøre for at fremstille den bedste iGPU i verden, ville være at erstatte en af disse chiplets med en GPU. De har også en god grund til at gøre det, da det ikke kun ville ændre spil til pc-spil, men også konsoller, da de fremstiller APU'erne til Xbox One og PS4 lineups.

De kunne endda sætte noget hurtigere grafikhukommelse på die, som en slags L4-cache, men de vil sandsynligvis bruge system-RAM igen og håber, at de kan forbedre hukommelsescontrolleren på tredje generation af Ryzen-produkter.

Uanset hvad der sker, har både det blå og det røde hold meget mere plads til at arbejde med på deres matricer, hvilket helt sikkert vil føre til, at i det mindste noget bliver bedre. Men hvem ved, måske pakker de begge bare så mange CPU-kerner ind, som de kan, og prøver at holde Moores lov i live lidt længere.