En veiledning til Googles skyvisjon

Maskinlæring. Dyp læring. Naturlig språkbehandling. Datamaskin syn. Automasjon. Stemme gjenkjenning. Du har sikkert hørt alle disse og mange andre vilkårene nylig, alt under paraplyen av kunstig intelligens. Faktisk vokser feltet så raskt, det blir stadig vanskeligere å spikse ned en endelig definisjon. Ai blir en del av nesten alle aspekter av våre liv, fra E-handel nettsteder og søkemotorer for å låse opp telefonen.

Nettstedene dine og appene kan utnytte APIer til å trykke direkte inn i kraften til AI. Uten å måtte "trene" AI-agenter, kan du dra nytte av massive mengder data som allerede er analysert. Google, Amazon, IBM og mange andre har skapt endepunkter for utviklere å kroke inn og begynne å bruke AI med en gang.

På forsiden kan du koble talekommandoer, chatbotgrensesnitt eller reaktive Webgl-kreative elementer. På bakenden bruker databasene intelligente algoritmer for å maksimere hastighet og analyse. APIer kan gi et lag av abstraksjon fra et bredt spekter av AI-funksjoner, fra spådommer til kollektiv trening.

Husk at hvis du gjør nettstedet ditt mer komplekst, er det viktig at du vurderer ditt valg av Web Hosting. service for å sikre at den kan håndtere det. Gjør et nettsted fra bunnen av? Vurder å forenkle prosessen med en topp Nettstedbygger . Og hvis du lager en ny Design System , det er viktig å holde det trygt og tilgjengelig i anstendig skylagring .

- En veiledning til Googles webverktøy

Hva er datasyn?

Computer Vision er studien og etableringen av kunstige systemer som trekker ut informasjon fra bilder. Det kan også omfatte det mekaniske systemet for synet selv. Når det gjelder anerkjennelse, er det prosessen med å analysere og bestemme innholdet i et bilde eller en serie av bilder (inkludert video). Dette kan inkludere medisinske skanninger, bilder, 360 graders video og nesten alle slags bilder du kan forestille deg.

AI-Powered Computer Vision Can:

- Identifiser, etikett og kategoriser innhold

- Oppdage ansikter og følelser

- Gjenkjenne hodeplagg som briller og hatter

- Identifisere landemerker, bygninger og strukturer

- Vurder Pixel-nivåinformasjon som fargedata, kvalitet og oppløsning

- Gjenkjenne populære logoer

- Identifisere og lese tekst

- Identifiser potensielt upassende bilder

Datasvisjon med Googles Cloud Vision API

Det er mange valg for Vision APIer, men vi skal bruke Googles Cloud Vision API. Google er vert for mange AI-APIer, inkludert naturlig språkbehandling, talegjenkjenning, dyp læring og syn.

Cloud Vision API gjør det mulig for nettstedene dine og appene å forstå hva som er i et bilde. Det vil klassifisere innholdet i kategorier, merking av alt det ser. Det gir også en konfidenspoengsum, så du vet hvor sannsynlig det er det som det tror er i et bilde som faktisk vises der. Du kan bruke dette til å samhandle intelligent angående kamerainngang i AR- eller videoapps. Du kan skape verktøy for å hjelpe de som er synshemmede. Du kan opprette assistenter for å hjelpe til med å identifisere bygninger eller landemerker for turister. Mulighetene er endeløse.

01. Sett opp et skyprosjekt

Hvis du har brukt Googles APIer før, vil noen av disse første trinnene være kjent. Som med andre Google-tjenester, må du sette opp et skyprosjekt. Gå til den Google Cloud Platform Console og opprett et nytt prosjekt eller velg en eksisterende. Som de fleste Googles tjenester, er Cloud Vision API gratis å bruke til du begynner å lage mange API-forespørsler. Du må kanskje angi faktureringsinformasjon når du aktiverer API, men dette er ikke belastet med et lavt volum på forespørsler, og du kan fjerne tjenestene etter at du er ferdig med testing.

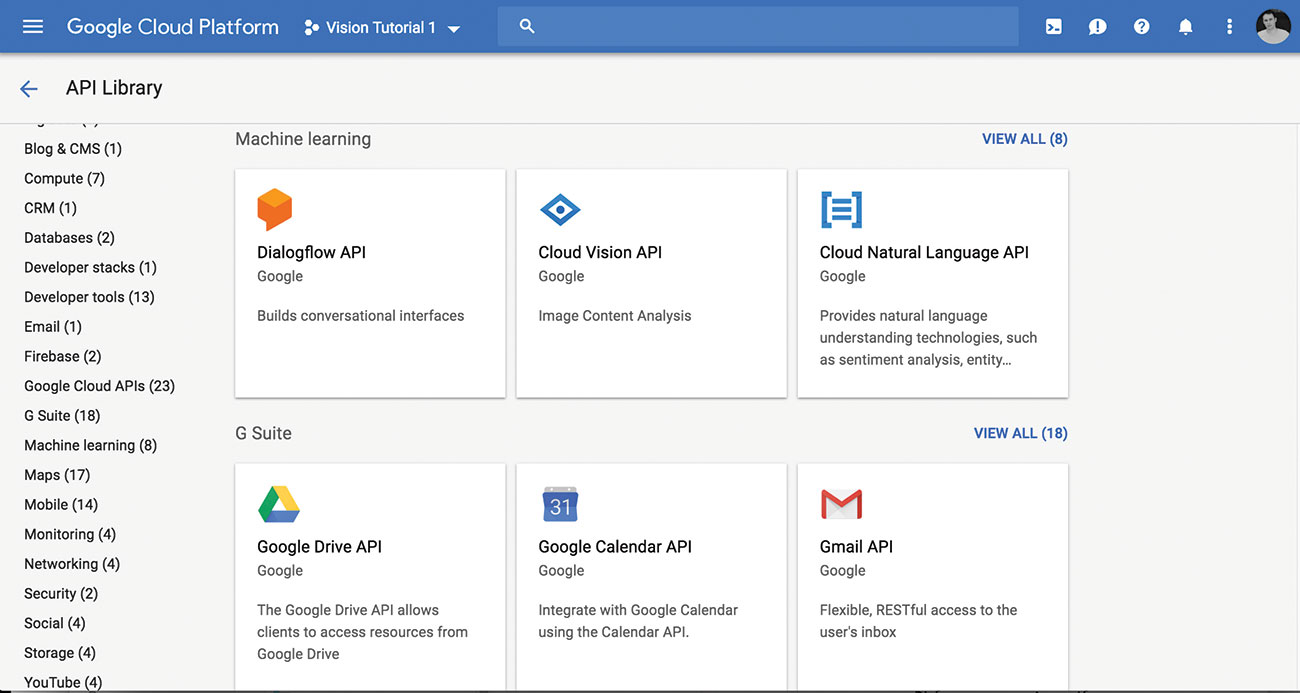

02. Aktiver Cloud Vision API

Bla gjennom API Library og velg Cloud Vision API for prosjektet ditt.

Når du har gjort det mulig, bør du se en liten grønn sjekk og meldingen 'API aktiverte' ved siden av den.

03. Opprett en servicekonto

Deretter må du sette opp en Servicekonto . Tenk på API som en webtjeneste du lager. Siden vi skal sette opp bruk som en typisk tjeneste, er dette den beste praksisen. Det fungerer også best med godkjenningsflyt.

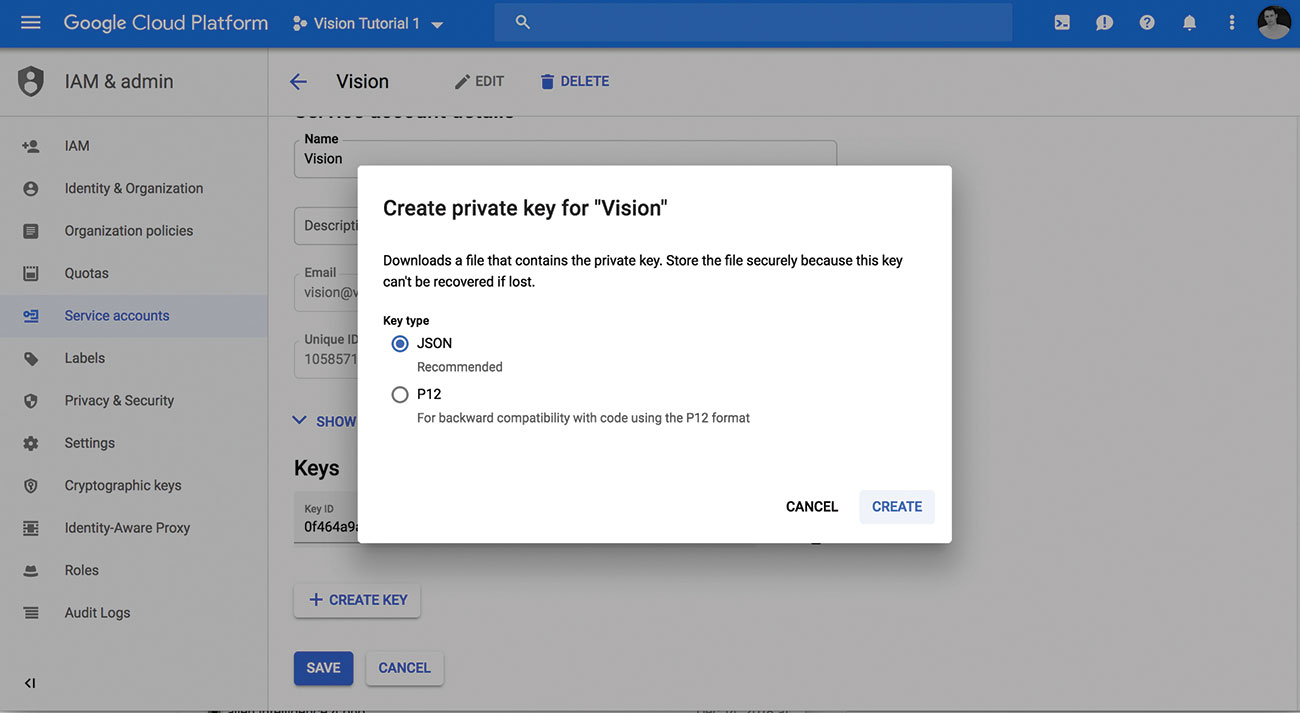

04. Last ned Privat Key

Når du har et prosjekt med API-aktivert og en servicekonto, kan du laste ned din private nøkkel som en JSON-fil. Legg merke til plasseringen av filen, slik at du kan bruke den i de neste trinnene.

Hvis du har noen problemer med de første få trinnene er det En rask startveiledning som hjelper og slutter med nedlastingen av JSON-nøkkelen.

05. Sett miljøvariabel

Du må sette Google_application_credentials. Miljøvennlig variabel, så den kan nås av våre API-anrop. Dette peker på JSON-filen du nettopp lastet ned og sparer deg for å skrive stien hver gang. Åpne et nytt terminalvindu og bruk eksport kommandoen som så:

export GOOGLE_APPLICATION_CREDENTIALS="/Users/[username]/Downloads/[file name].json"Erstatt den [Brukernavn] med brukernavnet ditt. Pass på at banen til stedet du lagret, den private nøkkelfilen er riktig. Erstatt den [filnavn] Med din private nøkkelfil og bruk banen til filen din.

På Windows kan du gjøre det samme via kommandolinjen, slik:

$env:GOOGLE_APPLICATION_CREDENTIALS="C:\Users\[username]\Downloads\[FILE_NAME].json"Merk: Hvis du lukker terminal- eller konsollvinduet, må du kanskje kjøre det igjen for å angi variabelen igjen. Vi legger til dette i vår PHP-kode i kort tid, så du trenger ikke å bekymre deg for det igjen.

06. Ringe til API

Nå er du klar til å grave inn i Cloud Vision API. Du bruker krøllen til å gjøre raske tester av API. Du kan også bruke denne metoden fra koden din også.

Curl-forespørsler kan gjøres på de fleste språk, enten det er PHP, Python eller node. På denne måten kan du ringe direkte i kommandolinjen eller tildele resultatet til en variabel på språket du ønsker. Finn noen raske tips om å bruke krøllen her .

Opprett en enkel JSON-fil for å holde detaljene i forespørselen. Kall det google_vision.json. . Oppbevar det lokalt til hvor du vil kjøre terminalkommandoene fra.

{

"forespørsler":[

{

"bilde":{

"kilde":{

"imageuri":

"https://upload.wikimedia.org/wikipedia/commons/9/93/golden_retriever_carlos_%2810581910556%29.jpg"

}

},

"egenskaper": [{

"Type": "Type_unSpecified",

"Maxresults": 50

},

{

"Type": "Landmark_detection",

"Maxresults": 50

},

{

"Type": "face_detection",

"Maxresults": 50

}

{

"Type": "Label_detection",

"Maxresults": 50

},

{

"Type": "Text_detection",

"Maxresults": 50

},

{

"Type": "Safe_search_detection",

"Maxresults": 50

},

{

"Type": "image_properties",

"Maxresults": 50

}

]

}

]

} I ovennevnte kode har du angitt et bilde for å analysere, samt spesifikke API-funksjoner som skal brukes, inkludert ansiktsgjenkjenning og landemerke-deteksjon. Safe_search_detection. er flott for å vite om bildet er trygt og i hvilken kategori den tilhører, for eksempel vokseninnhold eller voldelig. Image_properties. forteller deg om farger og piksel-nivå detaljer.

For å utføre Curl-kommandoen, i ditt terminal- eller kommandolinjegrensesnitt, skriv inn følgende.

Curl -X Post -H "Autorisasjon: Bærer" $ (GCloud Auth Application-standard Print-Access-Token) -H "Innholdstype: Søknad / JSON; Charset = UTF-8" - Data-Binary @ google_vision.json "https://vision.googleapis.com/v1/images:annotate" & gt; Resultater Ved å bruke den & gt; resultater. Syntaks, du får resultatene som er lagret i en ny fil som heter resultater for deg. Du indikerte nettadressen til API ( "https://vision.googleapis.com/v1/images:annotat" ) og inkluderte JSON-dataene dine til POST til det.

Du kan bli bedt om første gang du bruker dette til å aktivere API eller tillate tilgang. Svar ja eller y til den aktuelle spørsmålet, og det skal returnere JSON.

Hvis du åpner resultatfilen, får du JSON-data resultater fra Vision API-forespørselen. Her er en utdrag:

{

"Responses": [

{

"Labelannotasjoner": [

{

"Midt": "/ m / 0bt9lr",

"Beskrivelse": "hund",

"Score": 0.982986,

"Topicalitet": 0.982986

},

{

"Midt": "/ m / 01t032",

"Beskrivelse": "Golden Retriever",

"Score": 0.952482,

"Topicalitet": 0.952482

},

{

... Du ser noen svært nyttige resultater med en gang. Under Labelannotasjoner Node, du kan se en 98 prosent kamp som bildet inneholder en "hund" og en 95 prosent kamp som den inneholder en "Golden Retriever"! AI identifiserte allerede innholdet i bildet og andre detaljer, inkludert en "snute" og det faktum at det er sannsynlig en "sportslige hund".

Dette krevde ingen trening på din side på grunn av det allerede trentede Google Vision AI-systemet. Skanner gjennom resultatene, vil du se alt fra anbefalte avlingsområder - for automatisk beskjære bilder til emner - til utrolig detalj av hva som er i bildene, inkludert farger og innhold. Prøv det med andre bilder for å se hvor kraftig API er.

Du kan fortsette å bruke denne metoden for å teste samtalene vi bruker. Du kan også sette opp en lokal SDK på et språk du foretrekker og integrere det i appen din.

07. Installer klientbibliotek

Deretter vil du gjøre en enkel nettbasert app for å vise hvordan du integrerer API i prosjektene dine.

Det finnes en rekke SDKer tilgjengelig på en rekke språk for å gjøre integrering enkle. Du vil bruke PHP SDK for denne neste delen. Hvis du ønsker å finjustere koden som følger inn i et annet språk, er det en stor ressurs for SDK her .

Start med å sørge for at du har en prosjektmappe satt opp på din lokale eller eksterne server. Hvis du ikke har det allerede, få komponist og installer den til prosjektmappen din. Eventuelt kan du ha komponist allerede installert globalt, og det er bra også.

Kjør følgende komponistenkommando for å installere leverandørfilene for Cloud Vision SDK.

php -r "kopi (" https://getcomposer.org/Installer "," komponist-setup.php ");"

php -r "if (hash_file ('sha384', 'composer-setup.php') === '93b54496392c0627746 70AC18B134C3B3A95E5A5E5C8

F1A9F115F203B75BF9A129D5DAA8BA6A13E2CC8A1DA080.

6388A8 ') {ekko' installatør verifisert '; } else {ekko 'installatør korrupte'; unlink ('komponist-setup.php'); } ekko php_eol; "

php komponist-setup.php

php -r "unlink (" komponist-setup.php ");"

PHP Composer.phar krever Google / Cloud-Vision Komponist gjør en leverandørmappe i prosjektmappen din og installerer alle avhengighetene for deg. Hvis du sitter fast, og vil bruke PHP, kan du sjekke ut dette installere komponistressurser .

08. Opprett en ny fil

Opprett en ny PHP-fil i prosjektmappen din. Sett den opp, men du liker, men ta med et enkelt HTML-skjema for å laste opp bilder for rask testing. Her er et eksempel PHP-fil med skjemaet inkludert:

& lt;! DOCTYPE HTML & GT;

& lt; html & gt;

& lt; head & gt;

& lt; title & gt; Net - Computer Vision Tutorial & LT; / Title & GT;

& lt; / head & gt;

& lt; body & gt;

& lt; form action = "index.php" enctype = "multipart / form-data" metode = "post" & gt;

lt; h1 & gt; velg bilde & lt; / h1 & gt;

& lt; input type = "fil" navn = "fil" & gt; & lt; br / gt;

& lt; input type = "Send" Value = "Last opp bilde" NAME = "Send" & GT; & lt; br / & gt;

& lt; / form & gt;

& lt; div class = "resultater" & gt;

& lt;? php

// PHP-koden går her //

Hvis (! ISSET ($ _ POST ['Send'])) {Die (); }

? & gt;

& lt; / div & gt;

& lt; / body & gt;

& lt; / html & gt; Koden inneholder en grunnleggende HTML-fil med et skjema og en plassholder for PHP-kode. Koden begynner å sjekke for eksistensen av bildet, sendt fra skjemaet. Hvis det ikke er sendt ennå, gjør det ingenting.

09. Lagre bildet

Hvis du foretrekker å peke på bilder på nettet eller på systemet, hopper du over dette trinnet. Hvis du vil behandle bilder, velger du, legger til denne koden for å lagre bildet som er valgt.

// Lagre bilde

$ FilePath = $ _Files ["fil"] ["navn"];

hvis (move_uploaded_file ($ _ filer ["fil"] ["tmp_name"], $ FilePath)) {

ekko "& lt; p & gt;". $ FilePath. "Style = 'Bredde: 400px; Høyde: Auto;' / & gt; & lt; / p & gt; ";

} else {

ekko "feil !!";

} 10. Legg til miljøvariabel

Du må sette Google_application_credentials. variabel for det å autentisere. I PHP bruker vi Putenv. kommandoen for å angi en miljøvariabel. Legg til denne koden neste i PHP-koden din:

PutenV ('google_application_credentials = / Brukere / Richardmattka / Nedlastinger / Vision Tutorial 1-0F464A9A0F7B.JSON'); Bytt ut banen og filnavnet til JSON Private Key-filen.

11. Inkluder biblioteket

Legg til biblioteket og initialiserer LanguageClient. klasse i koden din. Legg til denne koden neste:

krever __dir__. '/Vendor/autoload.php';

Bruk Google \ Cloud \ Vision \ v1 \ ImageAnnotatorClient;

$ ProjectId = 'Vision-Tutorial-1';

$ imageAnnotator = ny imageAnnotatorClient ([

'prosjektid' = & gt; $ Prosjektid

]); Start med å kreve leverandøren Autoload. Dette er like i Python eller node når du trenger avhengigheter. Importere ImageAnnotatorclient. neste, for å gjøre bruk av klassen. Definer din Prosjektet . Hvis du ikke er sikker på hva dette er, se det opp i Google Cloud-prosjektkonsollen din. Til slutt, opprett en ny ImageAnnotatorclient. objekt ved hjelp av prosjektet ditt og tilordne det til $ imageAnnotator. variabel.

12. Analyser bildeinnhold

Begynn å sende inn bildet til API for analyse. Du vil vise resultatet som JSON på skjermen for nå, men i praksis kan du vurdere resultatene og bruke dem på en måte du ønsker.

Legg til følgende for å sende bildet til API.

$ image = fil_get_contents ($ FilePath);

$ respons = $ imageAnnotator- & gt; labdeTeteksjon ($ image);

$ etiketter = $ response- og gt; getlabelannotasjoner ();

foreach ($ etiketter som $ etikett) {

ekko "& lt; div klasse =" resultat "& gt;";

$ resultat = $ label- & gt; getdescription ();

ekko $ resultat. "(". $ label- & gt; getcore (). ")";

ekko "& lt; / div & gt;";

} Dette sender innholdet fra den innleverte skjemaet til imageAnnotator sluttpunkt og lagrer resultatet i $ respons. variabel. Det spesifiserer den LabdeTetEction. trekk. Du kan også bruke ansiktsgjenkjennelse , logodeteksjon , TextDetection. og mange andre funksjoner. For en fullstendig liste, Sjekk her .

Neste, iterate over listen over etiketter. Dette er bare et eksempel for å vise hvordan du bruker den: Du kan behandle den og reagere på resultatene, men du trenger.

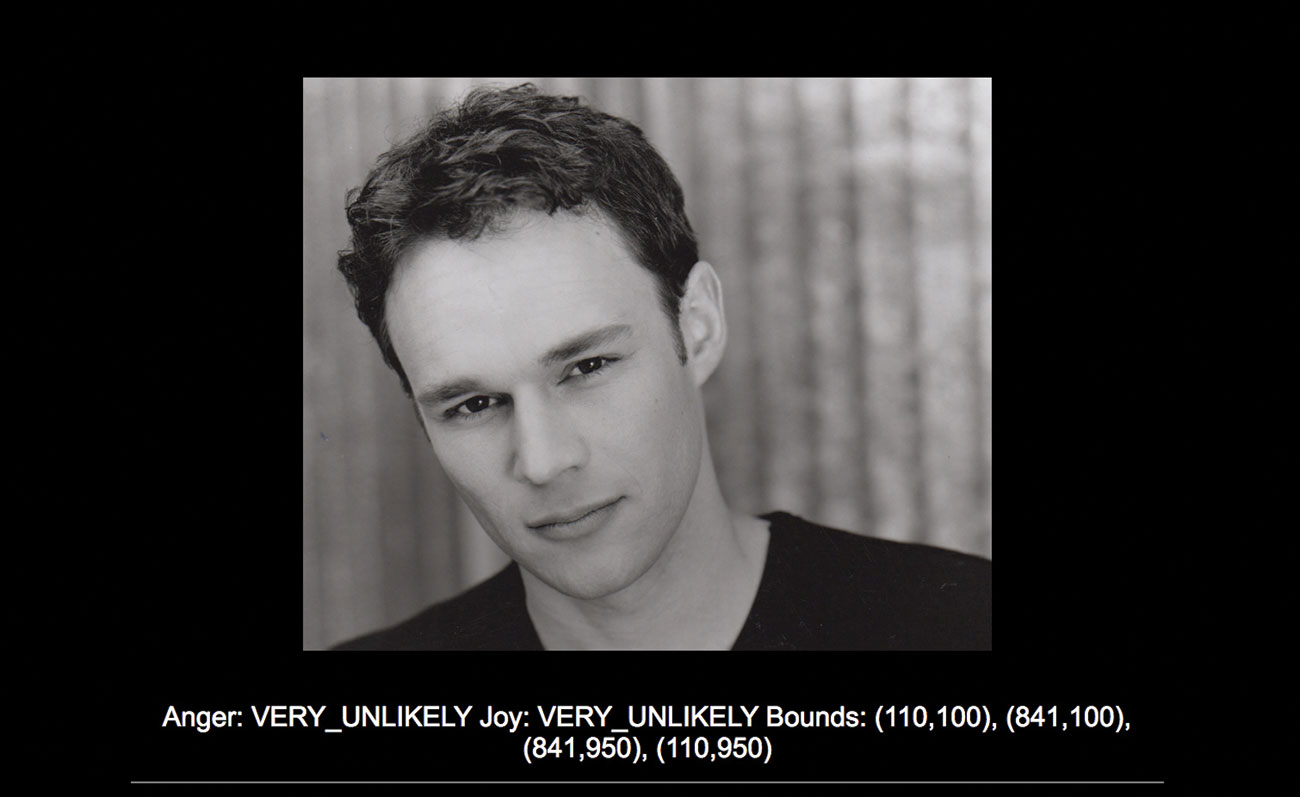

13. Oppdag ansikter

Et annet raskt eksempel på hvor kraftig API er løgner i ansiktsgjenkjennelse funksjon. Dette vil returnere følelsesdata, samt plasseringsinformasjon om hvor i bildet er ansiktene. Prøv denne koden for å se hvordan det fungerer.

$ respons = $ imageAnnotator- & gt; facedeteksjon ($ image);

$ ansikter = $ Response- & gt; GetFaceAnnotations ();

$ LikeliHoodName = ['Ukjent', 'very_unlikelt', 'usannsynlig',

'Mulig', 'sannsynligvis', 'very_likely'];

// var_dump ($ etiketter);

foreach ($ ansikter som $ ansikt) {

ekko "& lt; div klasse =" resultat "& gt;";

$ anger = $ face- & gt; getogerlikelihood ();

printf ("sinne:% s". php_eol, $ LikelihoodName [$ sinne]);

$ Joy = $ Face- & GT; GetjoyLikelihood ();

printf ("glede:% s". php_eol, $ LikelihoodName [$ Joy]);

$ Vertices = $ Face- & GT; GetboundingPoly () - & GT; Getvertices ();

$ grenser = [];

foreach ($ vertices as $ vertex) {

$ grenser [] = sprintf ('(% d,% d)', $ vertex- & gt; getx (), $ vertex- & gt; gety ());

}

Skriv ut ('grenser:'. Bli med (',', $ grenser). php_eol);

ekko "& lt; / div & gt;";

} Du starter med å bruke ansiktsgjenkjennelse Funksjonen til annotatoren og passere i bildet som forrige eksempel. Så får du faceannotiatons . Du bruker en rekke svarvekter på mer vanlig språk, slik at du kan se sannsynligheten for visse følelser. Etter dette, itererer du svaret som før. Du kontrollerer om to av flere mulige følelser, sinne og glede, og returnerer resultatene av dem. Dette vil også gi deg hjørnene til grenseboksene som definerer hvert ansikt som er funnet.

Denne artikkelen ble opprinnelig publisert i utgave 316 av nett , verdens bestselgende magasin for webdesignere og utviklere. Kjøp problem 316 her eller Abonner her .

Relaterte artikler:

- Amazing Ai Tool rekonstruerer bilder som magi

- 17 Toppverktøy i Google Analytics

- De beste kodedaktørene

hvordan - Mest populære artikler

Bygg en stemme kontrollert UI

hvordan Feb 2, 2026Vi har sett mange nye APIer lagt til på nettet de siste årene som har virkelig gjort det mulig for webinnhold å ha samme type funksjonalitet som mange apper har hatt i noen tid. En relativ..

Arbeidsbilde Mask Magic With Houdini

hvordan Feb 2, 2026[1. 3] Hvis du er interessert i å lære mer om Houdini, sørg for at du går på å generere New York (april 24-25). På kon..

Få mer fra grafitt med disse tipsene

hvordan Feb 2, 2026[1. 3] I de siste tre årene har jeg brukt grafitt som et medium for illustrasjon, først bare med mekaniske blyanter, deretter de..

Hvordan kombinere 3D og tegneserien i Zbrush

hvordan Feb 2, 2026Side 1 av 2: Side 1 Side 1 [1. 3] Side 2 [1. 3] ..

Hvordan velge med Photoshops Lasso Tools

hvordan Feb 2, 2026Valg er en av de mest vitale oppgavene du vil lære å mestre i Photoshop CC. . Et godt utvalg vil gi realisme til et bilde, for ikke å nevne renhet. Men med så mange utvalgs..

Anatomi MasterClass: Perfekt tallene dine

hvordan Feb 2, 2026[1. 3] I denne masterclassen avslører jeg de grunnleggende trinnene du trenger å følge for å lære Hvordan tegne figur..

Hvordan skulptur og utgjøre et tegneseriehode i Zbrush

hvordan Feb 2, 2026[1. 3] Da jeg ønsket å skape et morsomt stykke 3D Art. Med et goofy uttrykk så jeg et konsept av Randy Bishop, j..

Hvordan lage 3D-hår og pels

hvordan Feb 2, 2026[1. 3] Du kan lett bli overveldet første gang du jobber med pels i noen 3D Art. programvare. I denne opplæringen ..

Kategorier

- AI Og Maskinlæring

- AirPods

- Amazon

- Amazon Alexa & Amazon Echo

- Amazon Alexa & Amazon Echo

- Amazon Brann TV

- Amazon Prime Video

- Android

- Android Telefoner Og Tavle

- Android -telefoner Og Nettbrett

- Android TV

- Apple

- Apple App Store

- Apple HomeKit & Apple HomePod

- Apple Music

- Apple TV

- Apple Watch

- Apps & Web Apps

- Apper Og Webapper

- Lyd

- Chrome & Chrome OS

- Chromebook & Chrome OS

- Chrome

- Cloud & Internet

- Sky Og Internett

- Sky Og Internett

- Datamaskiner

- Computer History

- Ledningen Cutting & Streaming

- Ledning Og Streaming

- Splid

- Disney +

- DIY

- Elektriske Kjøretøyer

- Lesebrett

- Essentials

- Forklarere

- Spill

- Generelt

- Gmail

- Google Assistant Og Google Nest

- Google Assistant & Google Nest

- Google Chrome

- Google Docs

- Google Disk

- Google Maps

- Google Play-butikken

- Google Blad

- Google Slides

- Google TV

- Maskinvare

- HBO Maks

- Hvordan

- Hulu

- Internet Slang Og Forkortelser

- IPhone Og IPad

- Tenne

- Linux

- Mac

- Vedlikehold Og Optimalisering

- Microsoft Edge

- Microsoft Excel

- Microsoft Office

- Microsoft Outlook

- Microsoft PowerPoint

- Microsoft Lag

- Microsoft Word

- Mozilla Firefox

- Netflix

- Nintendo Switch

- Paramount +

- PC Gaming

- Peacock

- Foto

- Photoshop

- PlayStation

- Personvern Og Sikkerhet

- Personvern Og Sikkerhet

- Personvern Og Sikkerhet

- Product Roundups

- Programmering

- Bringebær Pi

- Roku

- Safari

- Samsung-telefoner Og Tavle

- Samsung -telefoner Og Nettbrett

- Slack

- Smart Home

- Snapchat

- Sosiale Medier

- Rom

- Spotify

- Tinder

- Feilsøking

- TV

- Video Games

- Virtuell Virkelighet

- VPN

- Nettlesere

- Wifi Og Routere

- Wifi & Ruters

- Windows

- Windows 10

- Windows 11

- Windows 7

- Xbox

- YouTube Og YouTube TV

- YouTube Og YouTube TV

- Zoom

- Explainers