Har du nogensinde spekuleret på, hvordan radio- og podcast-værter får deres signaturlyd? Mens noget af det kommer fra deres bedre hardware, kommer det meget ned til efterbehandling, som redigerer lyden, når den er optaget (eller nogle gange mens den er live) for at få den til at lyde meget bedre. Du kan bruge de samme teknikker til at få din mikrofon til at lyde bedre.

De to apps, vi bruger til efterbehandling af vores lyd er Adobe Audition og Audacity . Audition er et fremragende værktøj med en ren grænseflade. Audacity er gratis, men mangler nogle funktioner og er lidt sværere at bruge, men den ene er tilstrækkelig til vores anvendelser.

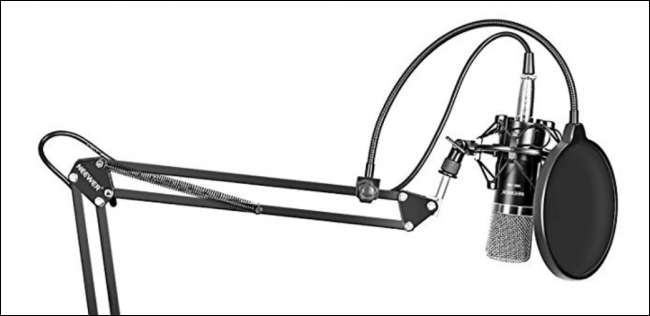

Køb en enkeltstående mikrofon

Mens efterbehandling kan hjælpe med at få din mikrofon til at lyde meget bedre, vil du stadig have et godt udgangspunkt i form af en anstændig mikrofon. Det primære problem her er støj. Mens lydefterbehandlingsapps som Audacity er gode til at EQing din stemme og gøre flad lydlyd professionel, kan den ikke slippe af støj særlig godt. Indbyggede mikrofoner er normalt små og opfanger en masse støj inde fra enhedens kasse. Store, uafhængige mikrofoner er generelt meget mindre støjende.

En fantastisk mikrofon kan let koste hundreder af dollars, men medmindre du er en lydprofessionel, vil du se faldende afkast på lydkvaliteten, som selv noget som TONOR BM-700 på kun $ 30 lyder utroligt sammenlignet med din bærbare eller telefons indbyggede mikrofon.

Støjreduktion

De fleste mikrofoner, selv avancerede, er ikke helt stille, og det er et af de første skridt til at rydde op i lyden ved at slippe af med irriterende baggrundsviss.

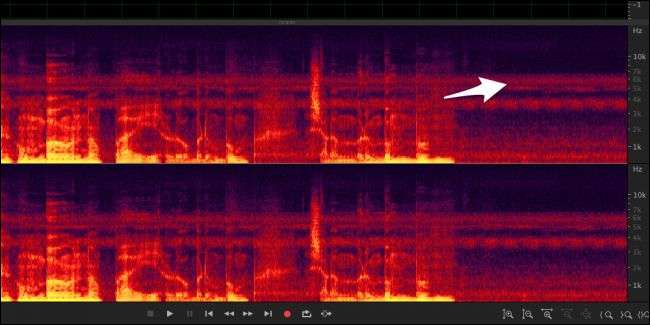

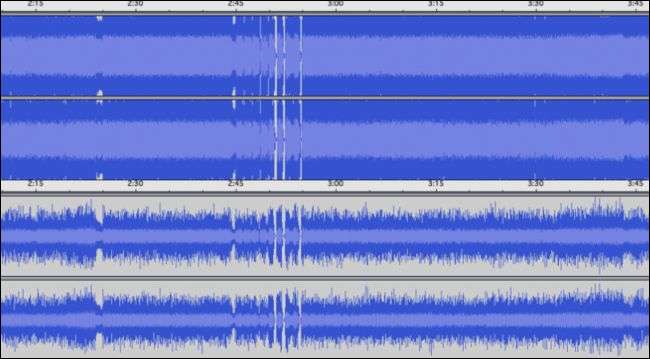

Den spektrale frekvensvisning i Audition er nyttig til visualisering af støj. Det viser støjniveauer ved hver frekvens over tid. Før støjreduktion kan du se her i slutningen af lyden (mens jeg ikke talte) er der stadig mange data. Når man ser nærmere på, strækker disse støjlinjer sig over hele lyden.

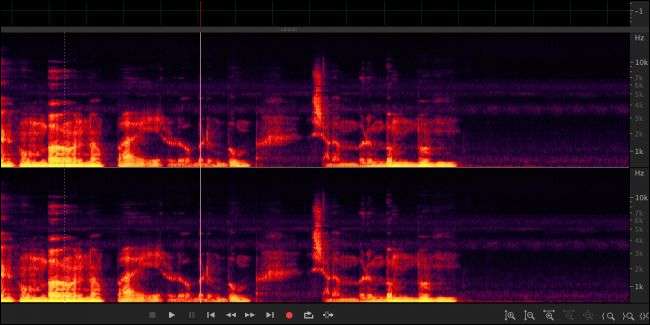

Efter støjreduktion er der stadig støj, men der er meget mindre af det.

Fordi det skærer disse frekvenser ud, forvrænger dette lyden en smule, og det er her, at have en mindre støjende mikrofon er praktisk, da du kun kan gøre det så meget, uden at det lyder som om du taler gennem en dåse.

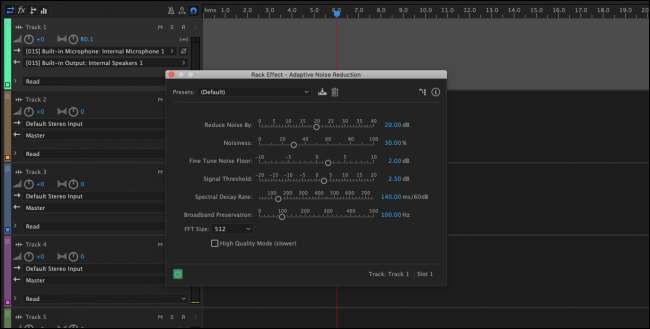

Du kan udføre støjreduktion på mange forskellige måder, men en af de bedste bruger noget, der kaldes støjudskrivning, til selektivt at fjerne støj og er nyttigt til al slags støj. Der er en masse andre effekter, såsom viskemiddel, som du kan bruge til at afbøde forskellige frekvenser og adaptiv støjreduktion, som ikke har brug for støjudskrivning.

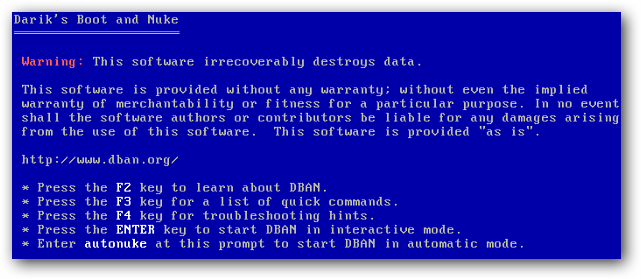

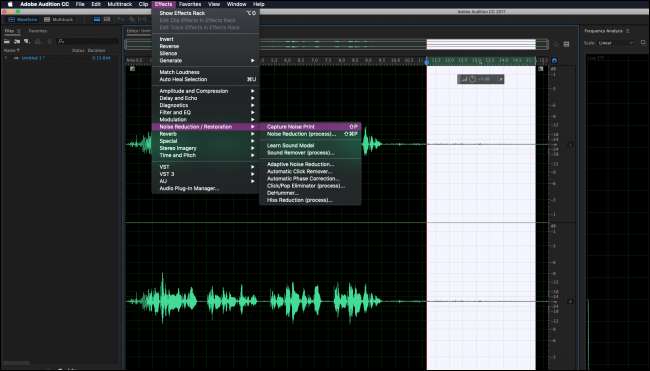

I Audition skal du først fange en støjudskrivning, før du kan bruge støjreduktion. Vælg en stille lydbit, og vælg Effekter> Støjreduktion> Optag støjudskrivning.

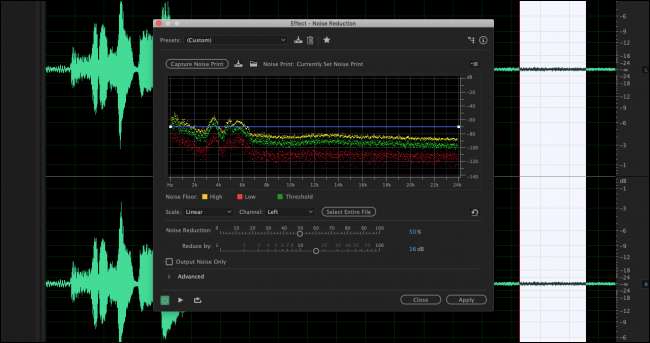

Vælg derefter “Noise Reduction (Process)” under den samme menu. Dette åbner en dialog, hvor du kan konfigurere reduktionsindstillingerne.

Standardindstillinger er normalt fine, men du kan justere støjgulvet, hvis du vil. Dette display viser dig, hvor meget støj det optager ved hver frekvens. Du kan få vist lyden med "Afspil" -knappen i nederste venstre hjørne, før du anvender dine ændringer. Du kan også vælge “Kun outputstøj” for at få vist al den støj, der fjernes. Når du gør dette, skal du holde hovedoptagelsen ude af støj for at minimere forvrængningen.

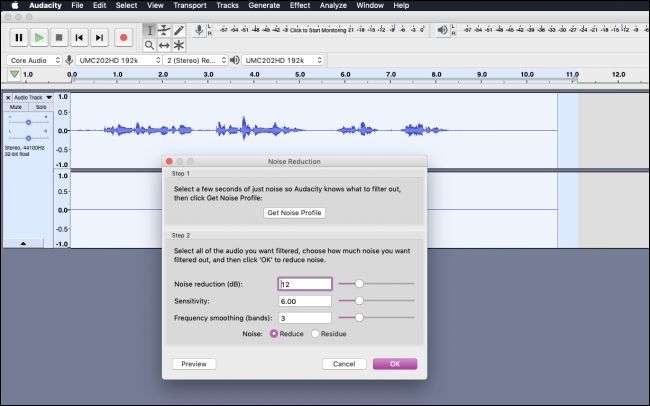

I Audacity skal du bare vælge Effekt> Støjreduktion. Herfra kan du indstille støjprofilen og et par andre indstillinger.

Audacity er ikke så fuldt udstyret som Auditions støjfjernelse, men får jobbet gjort.

Udligning

Equalization eller EQing justerer lydstyrken for forskellige tonehøjder i lyden. For eksempel kan du skrue bassen op eller skære den helt ud. I praksis er kunsten i EQ dog meget mere subtil og drejer sig om mindre justeringer for at gøre lyden god. Hvis du går efter en dyb radiostemme, tror du måske, at du bare skal skrue bassen op, men faktisk får dette din stemme til at lyde boomy og producerer ikke den ønskede effekt.

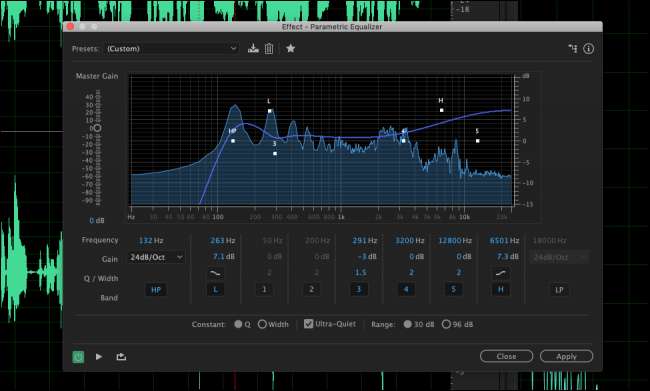

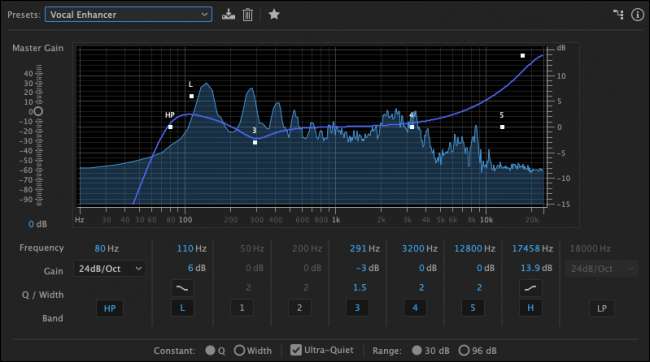

Forudindstillingen "Vocal Enhancer" i Audition vil sandsynligvis være bedst. Denne forudindstilling skærer den meget lave bas ud og øger frekvenserne, hvor vokal normalt findes. Du kan åbne dette vindue under Filter og EQ> Parametrisk equalizer. Ligesom støjreduktion skal du vælge en del af lyden til EQ, og du kan få vist dine ændringer med knappen "Afspil".

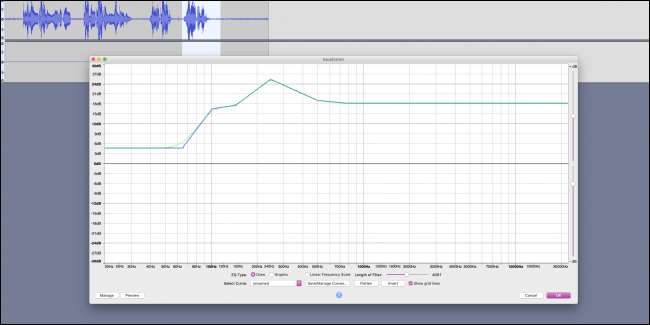

Du kan også EQ i Audacity under Effect> Equalization.

RELATEREDE: Sådan EQ og bland din mikrofon uden hardware

Kompression og normalisering

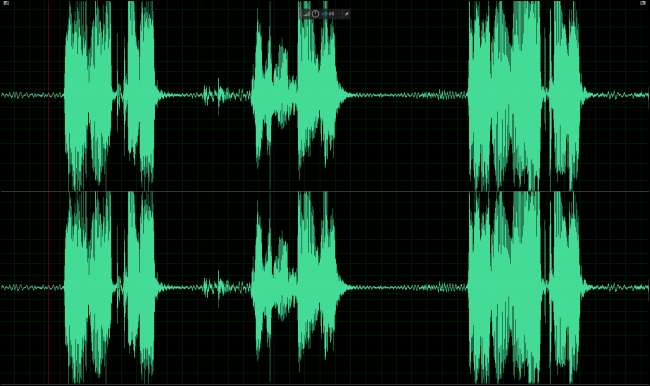

Et problem, du måske har med din mikrofon, er, hvor høj den er, jo tættere du er på den. Du kan ende med noget som det billede, der er vist ovenfor, med dele af lyden meget stille og dele meget højt i et klip, du gerne vil være ensartet.

Kompression løser dette problem. Denne type komprimering adskiller sig fra traditionel digital komprimering, som bruges til at reducere filstørrelser. Lydkomprimering forsøger at gøre klippet mere ensartet i volumen. Her er den samme voiceover ovenfra, men med en kompressor anvendt:

Bemærk, at dette også øger baggrundsstøjvolumen i pauserne og på mere støjsvage dele.

Dette er faktisk, hvad de fleste sange på radioen gør, kaldet " Loudness Wars “. Se denne bølgeform af radioredigeringen af en Metallica-sang versus en version, der kan downloades:

Radioredigeringen komprimeres og normaliseres til 100%, mens den version, der kan downloades, har fald i lydstyrken. Dette er dog et ekstremt eksempel, og du vil aldrig rigtig komprimere din lyd så meget i praksis. Nogle gange er denne ekstra information til "lydstyrke" nyttig, som for musik, men for ting som voiceovers vil du gerne have, at det er ret ensartet.

Normalisering svarer til komprimering og er normalt det sidste trin, du kører. Det tager hele klippet og gør den højeste del 100% lydstyrke. Dette er nyttigt til at holde en ensartet lydstyrke mellem forskellige klip. Så kompression gør volumen ensartet inden for klip, og normalisering gør det ensartet mellem klip. Brugt sammen lyder din lyd meget bedre.

Gør det live

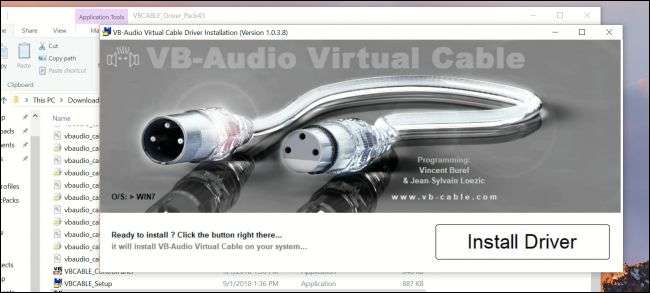

Både Audition og Audacity fungerer mest på forudindspillet lyd, så de er ikke for nyttige til live streaming alene. For at få output samlet i noget som OBS, skal du dirigere lyden inde i din computer.

Til dette bruger vi VB-kabel af VB-Audio, et helt gratis program. VB-kabel skaber et "virtuelt output", som du kan vælge som dine højttalere. Det sender din systemlyd til en anden virtuel input, som du kan indstille som din mikrofon i ethvert program. Du hører faktisk ikke output, mens du bruger den virtuelle output, hvilket er godt.

Audition har en skærmfunktion under sektionen Multitrack, som du kan bruge til at anvende nogle effekter i realtid og derefter udsende dem til dine hovedtelefoner til overvågning. Normalt vil dette lade dig lytte til din mikrofon, mens du optager. Men hvis du vælger den virtuelle kabelindgang som outputenhed, dirigerer VAC den til en mikrofonindgang, som du kan fange i OBS. En smuk hacky løsning, men det er den eneste måde at køre Audition-effekter live på din lyd.

Du kan ikke bruge alle funktioner, som f.eks. Støjudskrivningsbaseret støjreduktion og andre ting, der har brug for forudindspillet lyd, men mange funktioner fungerer stadig. Husk, at det at gøre dette med mange effekter er CPU-intensivt og kan påvirke ydeevnen på dit system, mens det kører.

Hvis du ikke har Audition eller ikke har brug for en komplet suite, kan du lave nogle grundlæggende EQing og mastering i VoiceMeeter Banan , også lavet af VB-Audio. Banan er den pro-version af almindelig VoiceMeeter, men de er begge gratis.

Banan indeholder en fuld parametrisk equalizer, som du kan bruge til at justere din mikrofons lyd i realtid.

Der er et par andre gode funktioner, som en støjport og nogle grundlæggende støjdæmpning. Og selvfølgelig kan du blande flere input og output, inden du sender dem til OBS.

Og hvis alt dette ikke passer til dine behov, kan du altid bruge VST-plugins i OBS.

Billedkredit: Lapandra / Shutterstock