Har du noen gang lurt på hvordan radio- og podcast-verter får signaturlyden? Mens noe av det kommer fra deres bedre maskinvare, kommer mye av det til etterbehandling, som redigerer lyden etter at den er spilt inn (eller noen ganger mens den er live) for å få den til å høres mye bedre ut. Du kan bruke de samme teknikkene for å få mikrofonen til å høres bedre ut.

De to appene vi vil bruke til etterbehandling av lyden vår er Adobe Audition og Audacity . Audition er et utmerket verktøy med et rent grensesnitt. Audacity er gratis, men mangler noen funksjoner og er litt vanskeligere å bruke, men en av dem er tilstrekkelig for vårt bruk.

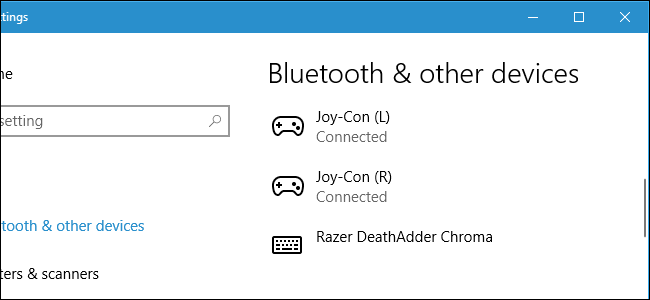

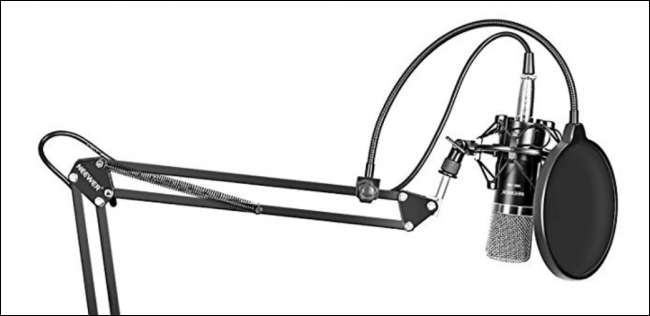

Kjøp en frittstående mikrofon

Mens etterbehandling kan bidra til at mikrofonen din høres mye bedre ut, vil du fortsatt ha et godt utgangspunkt i form av en anstendig mikrofon. Den primære bekymringen her er støy. Mens lydbehandlingsapper som Audacity er gode til å EQing stemmen din og gjøre flat lyd lyd profesjonell, kan den ikke bli kvitt støyen veldig bra. Innebygde mikrofoner er vanligvis små og henter mye støy fra enhetens etui. Store, frittstående mikrofoner er generelt mye mindre støyende.

En flott mikrofon kan lett koste hundrevis av dollar, men med mindre du er lydproff, vil du se avtagende avkastning på lydkvaliteten, som til og med noe som TONOR BM-700 på bare $ 30 høres utrolig ut i forhold til den bærbare datamaskinen eller telefonens innebygde mikrofon.

Støyreduksjon

De fleste mikrofoner, til og med avanserte, er ikke helt stille, og å bli kvitt irriterende bakgrunnssiss er et av de første trinnene i å rydde opp i lyden.

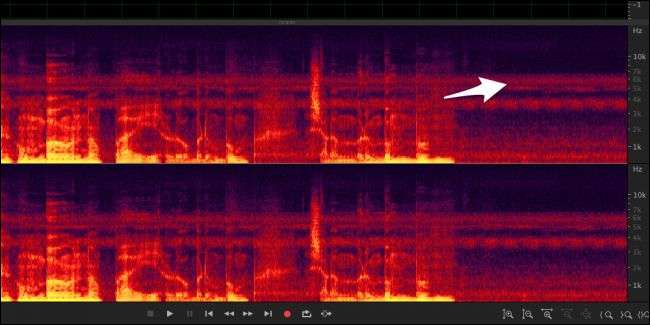

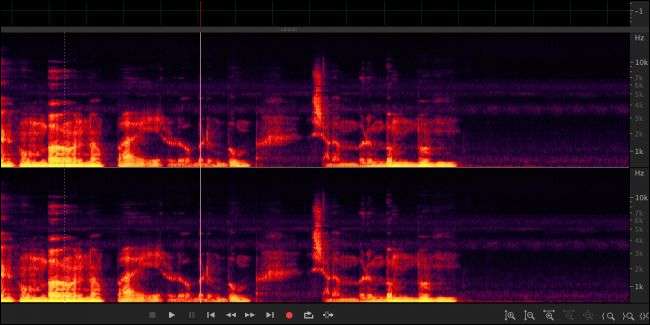

Den spektrale frekvensvisningen i Audition er nyttig for å visualisere støy. Den viser støynivåer ved hver frekvens over tid. Før støyreduksjon kan du se her på slutten av lyden (mens jeg ikke snakket) er det fortsatt mye data. Ser du nærmere, strekker disse støylinjene seg over all lyden.

Etter støyreduksjon er det fortsatt støy, men det er mye mindre av det.

Fordi det kutter ut disse frekvensene, forvrenger dette lyden litt, og det er her det å ha en mindre støyende mikrofon er nyttig, da du bare kan gjøre dette så mye uten at det høres ut som du snakker gjennom en blikkboks.

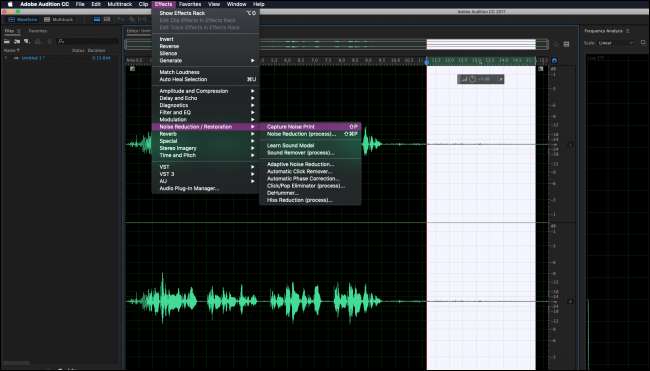

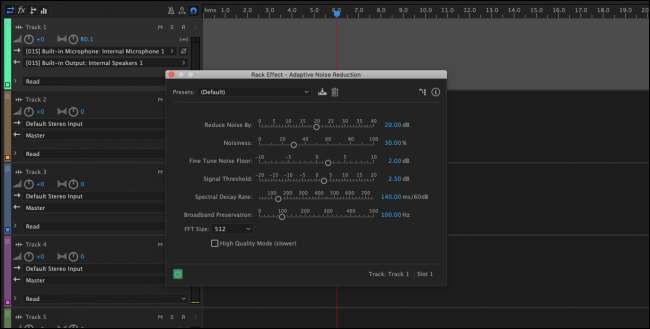

Du kan utføre støyreduksjon på mange forskjellige måter, men en av de beste bruker noe som kalles støyutskrift for å selektivt kutte ut støy, og er nyttig for all slags støy. Det er mange andre effekter, som susfjerner, som du kan bruke til å redusere forskjellige frekvenser, og adaptiv støyreduksjon, som ikke trenger støytrykk.

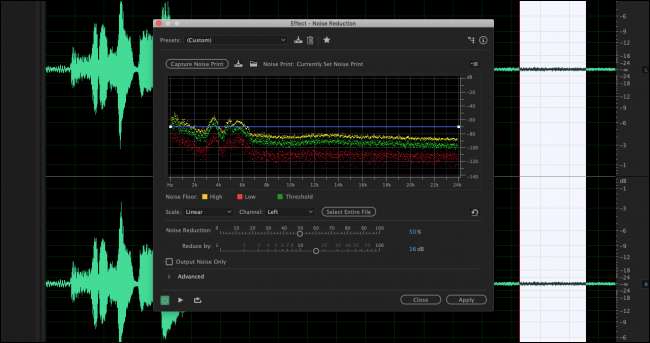

I Audition må du først ta en støyutskrift før du kan bruke støyreduksjonen. Velg en stille lydbit, og velg Effekter> Støyreduksjon> Ta ut støyutskrift.

Deretter velger du “Noise Reduction (Process)” under samme meny. Dette åpner en dialog der du kan konfigurere reduksjonsinnstillingene.

Standardinnstillinger er vanligvis fine, men du kan justere støygulvet hvis du vil. Denne skjermen viser deg hvor mye støy den fanger opp ved hver frekvens. Du kan forhåndsvise lyden med "Play" -knappen nederst til venstre før du bruker endringene. Du kan også velge "Kun utgangsstøy" for å forhåndsvise all støyen som blir fjernet. Når du gjør dette, prøv å holde hovedopptaket utenfor støyen for å minimere forvrengningen.

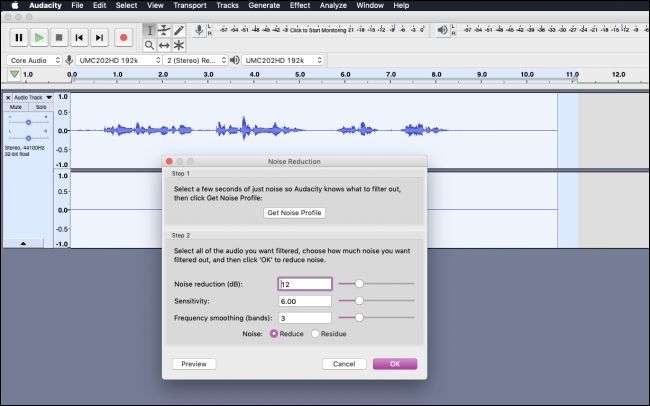

I Audacity er det bare å velge Effekt> Støyreduksjon. Herfra kan du stille inn støyprofilen og noen andre innstillinger.

Audacity er ikke like fullt utstyrt som Auditions støyfjerning, men vil få jobben gjort.

Utjevning

Equalization, eller EQing, justerer volumet til forskjellige tonehøyder i lyden. For eksempel kan du skru opp bassen eller kutte den helt ut. I praksis er kunsten EQ imidlertid mye mer subtil og dreier seg om mindre justeringer for å gjøre lyden god. Hvis du går etter en dyp radiostemme, kan du tro at du bare burde skru opp bassen, men faktisk vil dette få stemmen din til å lyde boomy og ikke gi den effekten du vil ha.

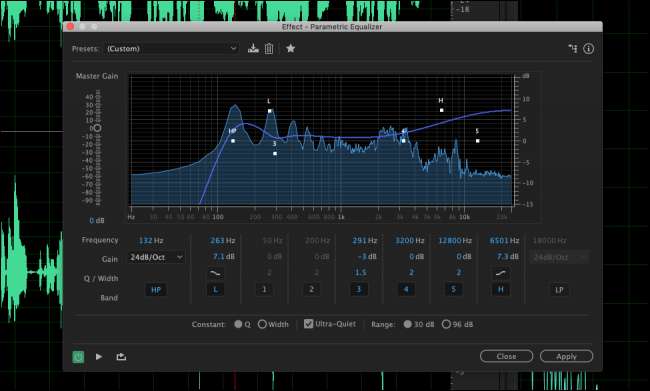

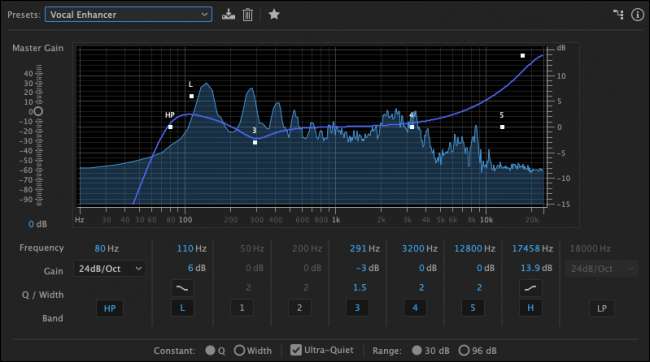

Forhåndsinnstilt "Vocal Enhancer" i Audition vil trolig være best. Denne forhåndsinnstillingen kutter ut den svært lave bassen og øker frekvensene der vokal vanligvis eksisterer. Du kan åpne dette vinduet under Filter og EQ> Parametrisk equalizer. I likhet med støyreduksjonen, må du velge en del av lyden til EQ, og du kan forhåndsvise endringene dine med "Play" -knappen.

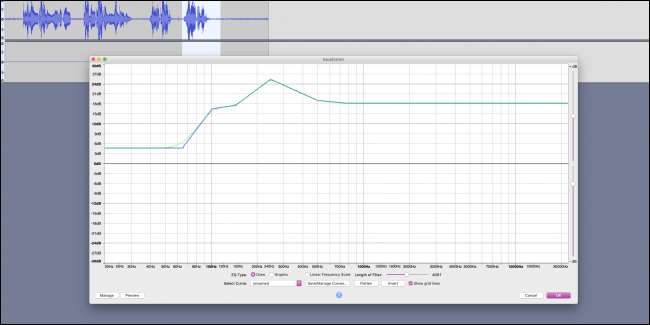

Du kan også EQ i Audacity under Effect> Equalization.

I SLEKT: Hvordan EQ og mikse mikrofonen uten maskinvare

Komprimering og normalisering

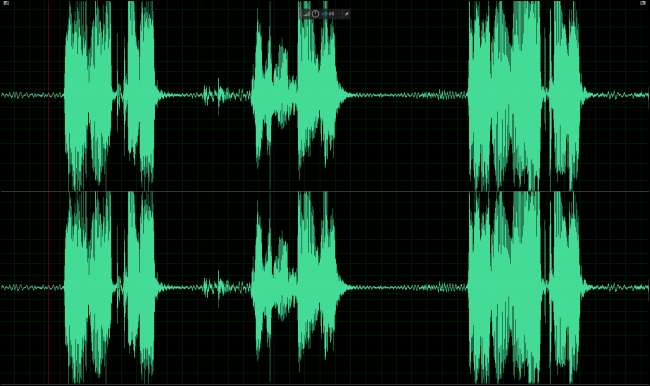

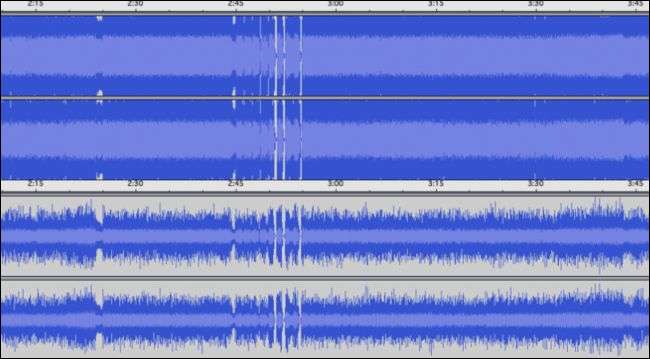

Et problem du kan ha med mikrofonen din er hvor høyt den er jo nærmere du er den. Du kan ende opp med noe som bildet som vises ovenfor, med deler av lyden veldig stille og deler veldig høye i et klipp du vil være ensartet.

Komprimering løser dette problemet. Denne typen komprimering er forskjellig fra tradisjonell digital komprimering, som brukes til å redusere filstørrelser. Lydkomprimering prøver å gjøre klippet mer jevnt i volum. Her er den samme voiceover ovenfra, men med en kompressor påført:

Vær oppmerksom på at dette også øker bakgrunnsstøyvolumet i pausene og på roligere deler.

Dette er faktisk det de fleste sanger på radioen gjør, referert til som " Loudness Wars “. Ta en titt på denne bølgeformen til radioredigeringen av en Metallica-sang versus en nedlastbar versjon:

Radioredigeringen er komprimert og normalisert til 100%, mens den nedlastbare versjonen har fall i volumnivåer. Dette er imidlertid et ekstremt eksempel, og du vil aldri komprimere lyden så mye i praksis. Noen ganger er denne ekstra informasjonen for "lydstyrke" nyttig, som for musikk, men for ting som stemmekonferanser, vil du at den skal være ganske jevn.

Normalisering ligner komprimering og er vanligvis det siste trinnet du kjører. Det tar hele klippet ditt, og gjør den høyeste delen til 100% volum. Dette er nyttig for å holde et jevnt volum mellom forskjellige klipp. Så komprimering gjør volumet jevnt i klipp, og normalisering gjør det jevnt mellom klipp. Brukt sammen vil lyden din høres mye bedre ut.

Gjør det live

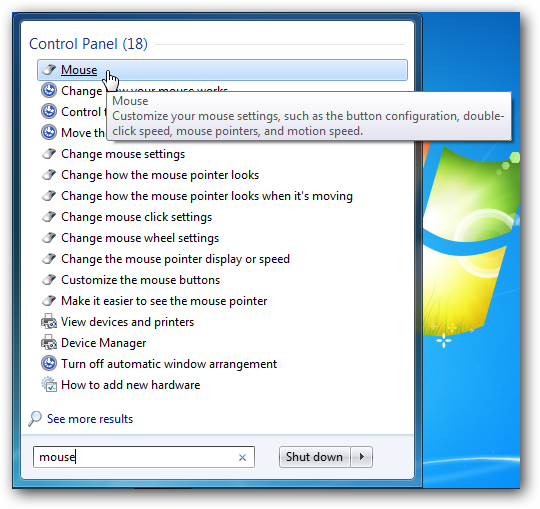

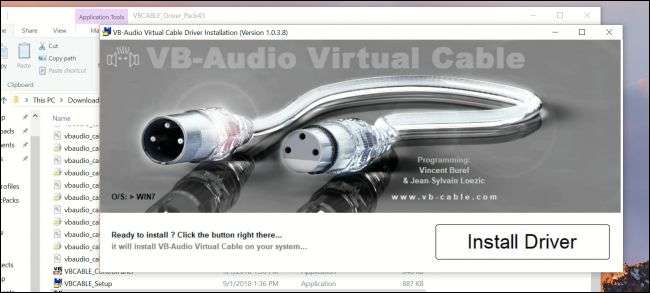

Både Audition og Audacity fungerer mest på forhåndsinnspilt lyd, så de er ikke så nyttige for live streaming alene. For å få utgangen plukket opp i noe som OBS, må du rute lyden inni datamaskinen.

For dette bruker vi VB-kabel av VB-Audio, et helt gratis program. VB Cable skaper en "virtuell utgang" som du kan velge som høyttalere. Den sender systemlyden til en annen virtuell inngang som du kan angi som mikrofon i ethvert program. Du hører faktisk ikke utgangen mens du bruker den virtuelle utgangen, noe som er bra.

Audition har en skjermfunksjon under Multitrack-delen, som du kan bruke til å bruke noen effekter i sanntid og deretter sende dem til hodetelefonene dine for å overvåke. Vanligvis kan du lytte til mikrofonen mens du spiller inn. Men hvis du velger den virtuelle kabelinngangen som utdataenhet, vil VAC dirigere den til en mikrofoninngang du kan fange i OBS. En ganske hacky løsning, men det er den eneste måten å kjøre Audition-effekter live på lyden din.

Du kan ikke bruke alle funksjoner, for eksempel støydempingsbasert støyreduksjon og andre ting som trenger forhåndsinnspilt lyd, men mange funksjoner vil fortsatt fungere. Husk at å gjøre dette med mange effekter er CPU-intensivt og kan påvirke ytelsen til systemet ditt mens du kjører.

Hvis du ikke har Audition, eller ikke trenger en komplett suite, kan du gjøre noen grunnleggende EQing og mastering i VoiceMeeter Banana , også laget av VB-Audio. Banana er pro-versjonen av vanlig VoiceMeeter, men de er begge gratis.

Banana har en full parametrisk equalizer som du kan bruke til å justere mikrofonens lyd i sanntid.

Det er noen andre gode funksjoner, som en støyport og noen grunnleggende støydemping. Og selvfølgelig kan du blande flere innganger og utganger før du sender dem til OBS.

Og hvis alt dette ikke passer dine behov, kan du alltid bruke VST-plugins i OBS.

Bildekreditt: Lapandra /Shutterstock