Temos a tendência de confiar no conteúdo das gravações de vídeo e áudio. Mas com a IA, o rosto ou a voz de qualquer pessoa podem ser recriados com extrema precisão. O produto é uma falsificação profunda, uma representação que pode ser usada para memes, desinformação ou pornografia.

Uma olhada no Deepfakes Nicholas Cage ou Jordan Peele's deepfake PSA deixa claro que estamos lidando com uma tecnologia nova e estranha. Esses exemplos, embora relativamente inofensivos, levantam questões sobre o futuro. Podemos confiar em vídeo e áudio? Podemos responsabilizar as pessoas por suas ações na tela? Estamos prontos para deepfakes?

Deepfakes são novos, fáceis de fazer e estão crescendo rapidamente

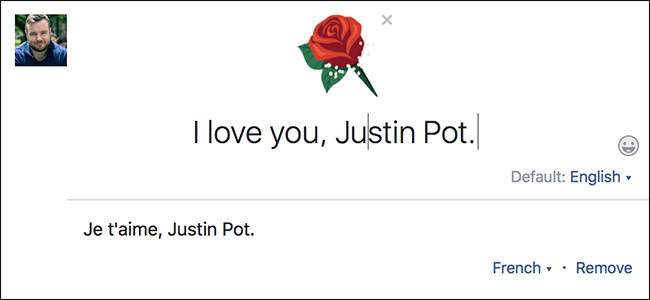

A tecnologia Deepfake tem apenas alguns anos, mas já explodiu em algo que é ao mesmo tempo cativante e perturbador. O termo "deepfake", que foi cunhado em um tópico do Reddit em 2017, é usado para descrever a recriação da aparência ou voz de um humano por meio da inteligência artificial. Surpreendentemente, quase qualquer pessoa pode criar um deepfake com um PC ruim, algum software e algumas horas de trabalho.

Como acontece com qualquer nova tecnologia, há alguma confusão em torno dos deepfakes. O vídeo do “Pelosi bêbado” é um excelente exemplo dessa confusão. Deepfakes são construídos por IA e são feitos para se passar por pessoas. O vídeo "dunk Pelosi", que já foi referido como deepfake, é na verdade apenas um vídeo de Nancy Pelosi que foi desacelerou e corrigiu o tom para adicionar um efeito de fala arrastada.

Isso também é o que torna deepfakery diferente, digamos, da CGI Carrie Fisher em Star Wars: Rogue One. Enquanto a Disney gastou muito dinheiro estudando o rosto de Carrie Fisher e recriando-o à mão, um nerd com algum software falso pode faça o mesmo trabalho de graça em um único dia. A IA torna o trabalho incrivelmente simples, barato e convincente.

Como fazer um Deepfake

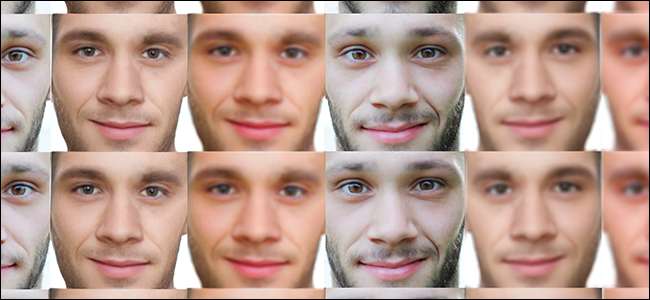

Como um aluno em uma sala de aula, a IA precisa “aprender” como realizar sua tarefa pretendida. Isso é feito por meio de um processo de tentativa e erro de força bruta, geralmente conhecido como aprendizado de máquina ou aprendizado profundo . Uma IA projetada para completar o primeiro nível de Super Mario Bros, por exemplo, jogará o jogo repetidamente até descobrir a melhor maneira de vencer. A pessoa que projeta a IA precisa fornecer alguns dados para dar início às coisas, junto com algumas “regras” quando as coisas dão errado ao longo do caminho. Além disso, a IA faz todo o trabalho.

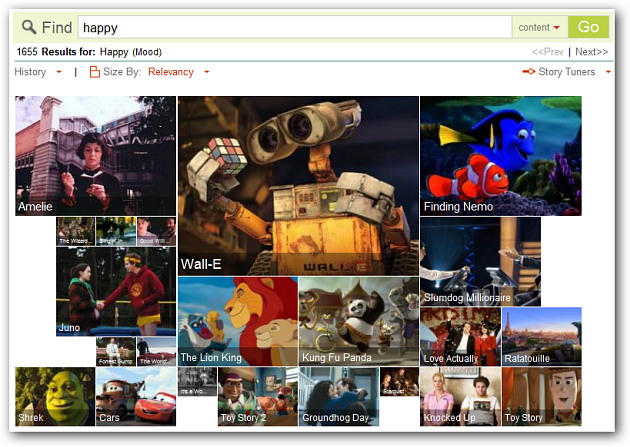

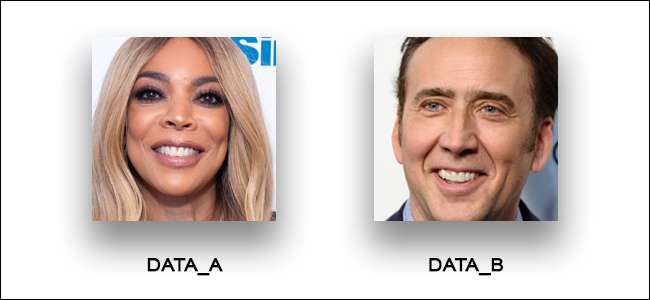

O mesmo se aplica à recreação facial falsa profunda. Mas, é claro, recriar rostos não é a mesma coisa que vencer um videogame. Se fôssemos criar um deepfake de Nicholas Cage apresentando o programa de Wendy Williams, aqui está o que precisaríamos:

- Um vídeo de destino : A partir de agora, deepfakes funcionam melhor com vídeos de destino claros e limpos. É por isso que alguns dos deepfakes mais convincentes são de políticos; eles tendem a ficar parados em um pódio sob iluminação consistente. Então, só precisamos de um vídeo de Wendy sentada quieta e conversando.

- Dois conjuntos de dados : Para que os movimentos da boca e da cabeça pareçam precisos, precisamos de um conjunto de dados do rosto de Wendy Williams e um conjunto de dados do rosto de Nicholas Cage. Se Wendy olhar para a direita, precisamos de uma foto de Nicholas Cage olhando para a direita. Se Wendy abrir a boca, precisamos de uma imagem de Cage abrindo a boca.

Depois disso, deixamos a IA fazer seu trabalho. Ele tenta criar o deepfake repetidamente, aprendendo com seus erros ao longo do caminho. Simples, certo? Bem, um vídeo do rosto de Cage no corpo de Wendy William não vai enganar ninguém, então como podemos ir um pouco mais longe?

Os deepfakes mais convincentes (e potencialmente prejudiciais) são personificações completas. O popular Obama deepfake por Jordan Peele é um bom exemplo. Então, vamos fazer uma dessas personificações. Vamos criar uma falsificação profunda de Mark Zuckerberg declarando seu ódio às formigas - isso parece convincente, certo? Aqui está o que precisamos:

- Um vídeo de destino : Este pode ser um vídeo do próprio Zuckerberg ou de um ator que se parece com Zuckerberg. Se nosso vídeo de destino for de um ator, vamos simplesmente colar o rosto de Zuckerberg no ator.

- Dados de fotos : Precisamos de fotos de Zuckerberg falando, piscando e movendo a cabeça. Se estivermos sobrepondo seu rosto a um ator, também precisaremos de um conjunto de dados dos movimentos faciais do ator.

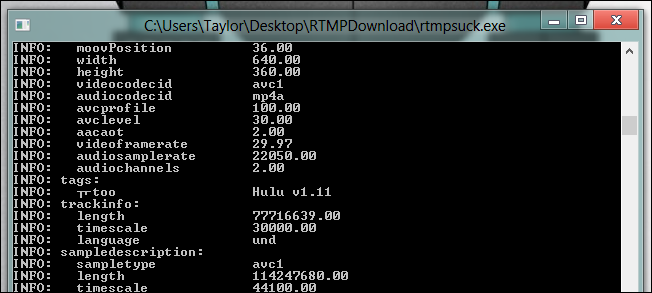

- A voz do Zuck : Nosso deepfake precisa soar como The Zuck. Podemos fazer isso gravando um imitador ou recriando a voz de Zuckerberg com IA. Para recriar sua voz, simplesmente executamos amostras de áudio de Zuckerberg por meio de uma IA como Lyrebird e digite o que queremos que ele diga.

- AI Lip-Sync : Já que somos adicionando a voz do falso Zuckerberg em nosso vídeo, uma sincronização labial precisa ter certeza de que os movimentos faciais profundos e falsos correspondem ao que está sendo dito.

Não estamos tentando minimizar o trabalho e a experiência necessários à falsificação profunda. Mas quando comparado ao trabalho CGI de milhões de dólares que trouxe Audrey Hepburn de volta dos mortos , deepfakes são um passeio no parque. E embora ainda não tenhamos caído por um deepfake político ou de celebridades, mesmo os deepfakes mais crappiest, mais óbvios, causaram danos reais.

RELACIONADOS: O problema com IA: as máquinas estão aprendendo coisas, mas não conseguem entendê-las

Deepfakes já causaram danos no mundo real

No momento, a maioria dos deepfakes são apenas memes de Nicholas Cage, anúncios de serviço público e pornografia assustadora com celebridades. Esses canais são relativamente inofensivos e fáceis de identificar, mas, em alguns casos, os deepfakes são usados com sucesso para espalhar informações incorretas e prejudicar a vida de outras pessoas.

Na Índia, deepfakes são empregados por nacionalistas hindus para desacreditar e incitar a violência contra jornalistas. Em 2018, um jornalista chamado Rana Ayyub foi vítima a essa campanha de desinformação, que incluía um vídeo falso do rosto dela sobreposto a um vídeo pornográfico. Isso levou a outras formas de assédio online e a ameaça de violência física .

Nos Estados Unidos, tecnologia deepfake é frequentemente usada para criar pornografia de vingança não consensual. Como relatado por Vice , muitos usuários no agora banido fórum deepfakes do Reddit perguntaram como criar deepfakes de ex-namoradas, paixões, amigos e colegas de classe (sim, pornografia infantil). O problema é tão grande que a Virgínia agora proíbe todas as formas de pornografia não consensual, incluindo deepfakes .

À medida que os deepfakes se tornam cada vez mais convincentes, a tecnologia sem dúvida será usada para propósitos mais duvidosos. Mas existe uma chance de estarmos exagerando, certo? Não é a etapa mais natural após o Photoshop?

Deepfakes são uma extensão natural de imagens manipuladas

Mesmo em seu nível mais básico, os deepfakes são perturbadores. Confiamos nas gravações de vídeo e áudio para capturar as palavras e ações das pessoas sem qualquer preconceito ou desinformação. Mas, de certa forma, a ameaça de deepfakes não é nada nova. Ele existe desde que começamos a usar a fotografia.

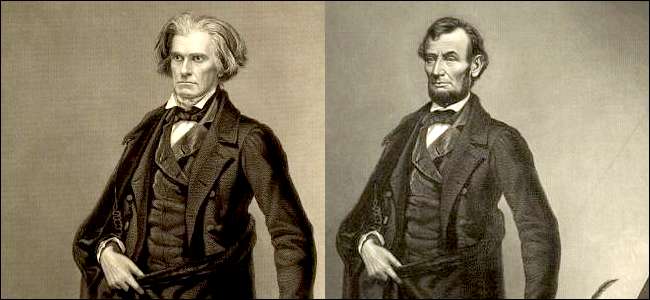

Veja, por exemplo, as poucas fotos que existem de Abraham Lincoln. A maioria dessas fotos (incluindo os retratos na moeda de um centavo e na nota de cinco dólares) foram medicados por um fotógrafo chamado Mathew Brady para melhorar a aparência esguia de Lincoln (especificamente seu pescoço fino). Alguns desses retratos foram editados de uma maneira que lembra falsificações profundas, com a cabeça de Lincoln sobreposta aos corpos de homens "fortes" como Calhoun (o exemplo abaixo é uma gravura, não uma fotografia).

Isso soa como uma publicidade bizarra, mas durante a década de 1860, a fotografia carregava uma certa quantidade de “verdade” que agora reservamos para gravações de vídeo e áudio. Era considerado o oposto da arte - uma ciência . Essas fotos foram adulteradas para desacreditar intencionalmente os jornais que criticaram Lincoln por seu corpo fraco. No final, funcionou. Os americanos ficaram impressionados com a figura de Lincoln, e o próprio Lincoln afirmou que as fotos de Brady “ me fez presidente .”

A conexão entre deepfakes e edição de fotos do século 19 é estranhamente reconfortante. Ele nos oferece a narrativa de que, embora essa tecnologia tenha consequências graves, não é algo que está totalmente fora de nosso controle. Mas, infelizmente, essa narrativa pode não durar muito.

Não seremos capazes de detectar falsas profundas para sempre

Estamos acostumados a ver imagens e vídeos falsos com nossos olhos. É fácil olhar para um Retrato de família Joseph Goebbels e dizer , "Há algo estranho sobre aquele cara nas costas." Uma olhada em Fotos de propaganda norte-coreana deixa evidente que, sem os tutoriais do YouTube, as pessoas são péssimas no Photoshop. E por mais impressionantes que os deepfakes sejam, ainda é possível para detectar um deepfake à primeira vista.

Mas não seremos capazes de detectar deepfakes por muito mais tempo. A cada ano, deepfakes se tornam mais convincentes e ainda mais fáceis de criar. Você pode fazer um deepfake com uma única foto , e você pode usar IA como Lyrebird para clonar vozes em menos de um minuto. Deepfakes de alta tecnologia que mesclam vídeo e áudio falsos são incrivelmente convincentes, mesmo quando são feitos para imitar figuras reconhecíveis como Mark Zuckerberg .

No futuro, podemos usar IA, algoritmos e tecnologia de blockchain para lutar contra deepfakes. Teoricamente, a IA poderia digitalizar vídeos em busca de deepfake “ impressões digitais , ”E a tecnologia de blockchain instalada em sistemas operacionais pode sinalizar usuários ou arquivos que tocaram em software deepfake.

Se esses métodos anti-deepfake parecem idiotas para você, junte-se ao clube. Até mesmo pesquisadores de IA duvidam que haja uma solução verdadeira para os deepfakes. Conforme o software de detecção fica melhor, o mesmo acontece com os deepfakes. Eventualmente, chegaremos a um ponto em que os deepfakes serão impossíveis de detectar e teremos muito mais com que nos preocupar do que pornografia falsa com celebridades e vídeos de Nicolas Cage.

![Como usar o Preenchimento automático em uma planilha do Google Docs [Quick Tips]](https://cdn.thefastcode.com/static/thumbs/how-to-use-autofill-on-a-google-docs-spreadsheet-quick-tips.jpg)